Willkommen!

Diese Woche zeichnet sich ein klares Muster ab: KI verlässt den Bildschirm und dringt in die physische Welt vor. NVIDIA präsentierte auf der GTC 2026 mit Vera Rubin eine Plattform für autonome Agenten in Fabriken und Operationssälen, OpenAI plant bis 2028 einen vollautomatisierten Forscher, und in China erlebt OpenClaw trotz Sicherheitsbedenken einen Massenhype. Parallel entsteht ein Wettlauf um vertikale Integration: Musk baut eigene Chipfabriken für Tesla und SpaceX, Bezos plant einen 100-Milliarden-Fonds zum Aufkauf von Fertigungsunternehmen, die mit KI automatisiert werden sollen. Diese Entwicklungen deuten auf eine fundamentale Verschiebung hin – von KI als Assistenztechnologie zu KI als autonomer Produktionskraft, die operative Prozesse direkt steuert und dabei neue Machtstrukturen schafft.

Wenn Sie gerade Ihr überfülltes Mail-Postfach abarbeiten und sich fragen, ob das nicht mit KI einfacher geht, dann haben Sie in zwei Tagen die Gelegenheit, zu erfahren, wie: Wie im letzten Newsletter angekündigt, zeigt Workist am 26. März um 11 Uhr bei einem kostenlosen Online-Webinar, wie KI-Agenten unstrukturierte E-Mail-Inhalte aus dem Vertriebsinnendienst automatisiert in ERP-Systeme übertragen können, welche Automatisierungsgrade bereits realistisch sind und wie Sie durch Human-in-the-Loop-Mechanismen die Kontrolle behalten.

Damit das KI-Briefing für Sie maximal nützlich bleibt, freuen wir uns über Ihr Feedback. Teilen Sie uns gerne mit, welche Impulse für Sie am wertvollsten sind – und helfen Sie dabei, unser Briefing in Ihrem Netzwerk bekannt zu machen. Gemeinsam können wir eine Community aufbauen, die voneinander lernt und sich gegenseitig stärkt. Falls Sie diesen Newsletter weitergeleitet bekommen haben, können Sie sich ganz einfach hier anmelden.

Was Sie in diesem Briefing erwartet

News: NVIDIA GTC 2026 bringt Vera Rubin und neue Ära der physischen KI, Trump-Regierung legt Rahmen für bundesweite KI-Regulierung vor, Musk plant zwei Chipfabriken in Texas für Tesla und SpaceX, Bezos plant 100-Milliarden-Dollar-Fonds für KI-gestützte Industrieübernahmen, OpenClaw boomt in China trotz wachsender Sicherheitsbedenken, OpenAI plant vollautomatisierten KI-Forscher bis 2028 & Mistral AI bietet Frontier-Modelle für Unternehmensdaten an

Deep Dive: Wenn Maschinen die Welt wirklich verstehen lernen statt nur über sie zu reden

In aller Kürze: Nvidia positioniert sich mit Open-Source-Plattform NemoClaw als Betriebssystem-Anbieter für KI-Agenten, Anthropic verklagt US-Regierung wegen Ausschluss von Claude aus Bundesbehörden, Nvidia nimmt H200-Produktion für China unter Umsatzteilung mit US-Regierung wieder auf, OpenAI übernimmt Astral zur Integration von Python-Entwicklerwerkzeugen in Codex-Plattform & Microsoft erwägt rechtliche Schritte gegen Amazon und OpenAI wegen 50-Milliarden-Deal

Videos & Artikel: Google-Tochter entwickelt Algorithmus für zehnmal effizienteres RLHF beim KI-Training, Stripe und Tempo stellen Machine Payments Protocol für autonome Zahlungen durch KI-Agenten vor, Xiaomi veröffentlicht MiMo-V2-Pro mit GPT-5.2-Leistung bei einem Sechstel der Kosten, Bernie Sanders diskutiert mit Claude Risiken von KI-basierter Datensammlung und politischem Microtargeting & Gum-Loop-CEO warnt vor blindem Einsatz von KI-Agenten ohne tiefgreifendes Domänenwissen

Impuls: Warum Ihre KI-Strategie an Menschen scheitert, nicht an Modellen

Umfrage: EU Inc. wird wie vorgeschlagen umgesetzt – was beeinflusst die Wettbewerbsfähigkeit europäischer KI-Unternehmen am stärksten?

Meinung der Redaktion: Warum EU Inc. über Europas Zukunft in der KI-Ära entscheidet

Praxisbeispiel: Wie Top-Performer KI nutzen und was Unternehmen daraus lernen können

YouTube: Warum Jensen Huang die Zukunft des Rechnens nicht vorhersagt, sondern erschafft

NVIDIA GTC

NVIDIA GTC 2026 bringt Vera Rubin und neue Ära der physischen KI

Zusammenfassung: NVIDIA hat auf der GTC 2026 die neue Vera Rubin-Plattform vorgestellt, ein Full-Stack-System aus sieben Chips und fünf Rack-Systemen für agentische KI. CEO Jensen Huang kündigte mindestens eine Billion Dollar Umsatz bis 2027 an und präsentierte Partnerschaften mit AWS, Microsoft und Oracle. Schwerpunkte waren physische KI für Robotik, neue Workstation-Systeme mit DGX Spark sowie die NemoClaw-Plattform für sichere autonome Agenten. Die Veranstaltung zeigte die Verlagerung von Prompt-basierten KI-Tools hin zu langfristig agierenden, autonomen Systemen.

Vera Rubin und Feynman-Architektur: Die neue Computing-Plattform umfasst die Vera-CPU und BlueField-4-STX-Speicherarchitektur. Die nachfolgende Feynman-Generation bringt mit Rosa eine neue CPU für effiziente Datenbewegung und kombiniert den LP40-LPU mit BlueField-5. Damit adressiert NVIDIA alle Säulen der KI-Fabrik von Compute bis Sicherheit.

AWS-Partnerschaft mit über 1 Million GPUs: AWS wird mehr als eine Million NVIDIA-GPUs sowie Blackwell-, Rubin- und Groq-3-LPU-Architekturen ausrollen. Die Deployment-Phase startet 2026 und soll Unternehmen, Startups und Forschungseinrichtungen die Infrastruktur für agentische KI-Systeme bereitstellen, die autonom über komplexe Workflows hinweg agieren.

Physische KI für Industrie und Gesundheit: IGX Thor ist allgemein verfügbar und bringt Echtzeit-KI an industrielle Edge-Standorte. Caterpillar, Hitachi Rail, Johnson & Johnson und Medtronic setzen die Plattform ein. Neue offene Healthcare-Modelle wie Open-H, Cosmos-H und GR00T-H beschleunigen chirurgische Robotik mit über 700 Stunden Trainingsdaten.

Warum das wichtig ist: NVIDIA verschiebt mit Vera Rubin die Grenzen von reiner Rechenleistung hin zu durchgängig optimierten KI-Systemen, die Software und Silizium als Einheit behandeln. Die angekündigte Billion-Dollar-Umsatzschwelle bis 2027 unterstreicht die explosionsartige Nachfrage nach KI-Infrastruktur. Für Cloud-Anbieter wie AWS entsteht ein Wettlauf um Kapazität und Performance, während Unternehmen ohne eigene Foundation Models zunehmend auf Hyperscaler angewiesen sind. Die Fokussierung auf physische KI und autonome Agenten zeigt eine strategische Neuausrichtung: KI verlässt den Bildschirm und greift in operative Prozesse ein – von Fabriken über Operationssäle bis zu autonomen Fahrzeugen. Dies eröffnet neue Geschäftsfelder, birgt aber auch regulatorische und sicherheitstechnische Herausforderungen, die sich auf Marktdynamiken und Zulassungsverfahren auswirken werden.

Präsentiert von Augment

Augment startet MBA-Alternative für moderne Führungskräfte

Zusammenfassung: Die Online-Business-School Augment expandiert 2026 nach Deutschland, Österreich und die Schweiz und positioniert sich als radikale Alternative zum herkömmlichen MBA. Das Programm kostet 1.470 bis 2.450 US-Dollar statt wie üblich über 100.000 US-Dollar und wird von Gründern wie Jimmy Wales (Wikipedia), Uri Levine (Waze) und Zack Kass (ehemals OpenAI) unterrichtet. Nach einer 6-Millionen-Euro-Finanzierung zählt die Plattform mittlerweile über 5.000 Teilnehmer. Die Gründer Roy Wellner und Ariel Renous brachen ihren eigenen Elite-MBA ab, weil Professoren ohne Gründungserfahrung unterrichteten. Ihr Gegenentwurf: 15 Minuten täglich, keine Akkreditierung, nur Praxiswissen von Unternehmern mit kollektiv 100 Milliarden Dollar Unternehmenswert.

Insider-Wissen von Milliarden-Dollar-Gründern: Jimmy Wales erklärt Community-Building, Uri Levine lehrt Problemlösung, Steve Chen teilt Skalierungsstrategien. Das Curriculum basiert nicht auf Lehrbüchern, sondern auf destillierten Erfahrungen aus dem Aufbau globaler Plattformen. Die Dozenten vermitteln genau die Strategien, mit denen sie selbst Märkte erobert haben.

KI strategisch nutzen, nicht nur verstehen: Module wie Prompt Engineering und Vibe Coding behandeln KI als fundamentales Werkzeug moderner Führung. Zack Kass (OpenAI) unterrichtet Go-to-Market-Strategien für KI-Produkte, Georgia Lewis Anderson (Meta) vermittelt, wie man Large Language Models erfolgreich einsetzt. Der Fokus liegt auf sofortiger Anwendbarkeit im eigenen Unternehmen.

Messbare Geschäftsergebnisse in Wochen: Ein Student sicherte sich nach dem Programm siebenstellige Investitionszusagen. Ein CFO bezeichnete es als beste Investition in sein berufliches Wachstum. Mit 15-tägiger Geld-zurück-Garantie und flexiblem Zugang können Führungskräfte das Programm parallel zum Tagesgeschäft absolvieren.

Warum das wichtig ist: Für Führungskräfte, die KI strategisch in ihre Organisation integrieren wollen, bietet Augment einen entscheidenden Vorteil gegenüber klassischen Weiterbildungen. Statt theoretischer Frameworks lernen Sie von Menschen, die selbst disruptive Geschäftsmodelle gebaut haben. Die Kombination aus kompaktem Format, direkter Anwendbarkeit und Expertise von Gründern wie dem ehemaligen OpenAI-Strategiechef macht das Programm zur schnellsten Route von Wissen zu messbaren Resultaten. Mit der DACH-Expansion wird diese Form der Executive Education erstmals auch hier verfügbar.

Exklusiv für unsere Community: Über den untenstehenden Link erhalten KI-Briefing-Leser das gesamte Augment MBA Programm mit einem Rabatt von 60%.

US-Politik

Trump-Regierung legt Rahmen für bundesweite KI-Regulierung vor

Quelle: Shutterstock

Zusammenfassung: Das Weiße Haus veröffentlichte am Freitag sein nationales Rahmenwerk für KI-Gesetzgebung und will damit einzelstaatliche Regelungen verhindern. Der Vorstoß basiert auf einer Verfügung von Präsident Trump aus dem Dezember, die bereits bestehende staatliche KI-Vorschriften außer Kraft setzte. Das Rahmenwerk setzt auf minimale Regulierung, fordert sektorspezifische Aufsicht statt einer zentralen Behörde und untersagt Bundesstaaten explizit, die Entwicklung von KI-Modellen zu regulieren.

Rechenzentren und Infrastruktur priorisiert: Das Rahmenwerk fordert vereinfachte Genehmigungen für Rechenzentren mit eigener Stromversorgung. Zudem sollen Urheberrechte mit KI-Training in Einklang gebracht und Gesetze gegen KI-Betrugsfälle verschärft werden.

Kritik an fehlender Verantwortlichkeit: Brendan Steinhauser von The Alliance for Secure AI bemängelt fehlende Rechenschaftspflicht bei Schäden. Brad Carson von der Anthropic-nahen Gruppe Public First Action vergleicht den Plan mit der gescheiterten Social-Media-Regulierung.

Silicon Valley begrüßt Light-Touch-Ansatz: Collin McCune von Andreessen Horowitz nennt das Rahmenwerk einen großen Schritt für klare Innovationsvorgaben. Die Regierung begründet die Blockade staatlicher Vorschriften mit dem Wettbewerb gegen China.

Warum das wichtig ist: Die Trump-Regierung kodifiziert einen Ansatz, der Tech-Unternehmen maximale Freiheit gewährt und dezentrale Kontrollversuche blockiert. Für KI-Firmen entsteht ein günstiges Umfeld ohne fragmentierte Compliance-Anforderungen. Bundesstaaten verlieren ihre Rolle als Innovationslabore für Schutzvorschriften, die historisch oft Impulse für spätere Bundesgesetze lieferten. Das Rahmenwerk verschiebt faktisch die Definitionsmacht über KI-Einsatzgrenzen von föderalen Strukturen zu Branchenakteuren und einer Bundesebene, die explizit auf Geschwindigkeit statt Vorsicht setzt. Mittelfristig könnte das transatlantische Regulierungsdivergenz vertiefen, da die EU mit dem AI Act den entgegengesetzten Weg eingeschlagen hat.

Chipfertigung

Musk plant zwei Chipfabriken in Texas für Tesla und SpaceX

Quelle: Shutterstock

Zusammenfassung: Tesla und SpaceX wollen in Austin zwei spezialisierte Halbleiterfabriken unter dem Namen „Terafab" errichten. Ein Werk soll Chips für Elektrofahrzeuge und humanoide Roboter produzieren, das andere für KI-Rechenzentren im Weltraum. Musk begründet das Projekt mit massivem Eigenbedarf, den externe Lieferanten nicht decken könnten. Auch sein KI-Unternehmen xAI ist beteiligt. Das Projekt zielt auf eine Rechenleistung von einem Terawatt pro Jahr ab, wobei der Großteil im Weltraum eingesetzt werden soll.

Vertikale Integration unter Druck: Musk beschreibt die weltweite Chipproduktion als zu gering für seinen künftigen Bedarf. Die Eigenproduktion soll strategische Abhängigkeiten von Zulieferern wie TSMC oder Samsung beseitigen und Engpässe vermeiden.

Weltraum-Chips als neues Segment: Die zweite Fabrik entwickelt Halbleiter für extreme Umgebungen und höhere Temperaturen. Das adressiert ein bislang kaum erschlossenes Marktsegment für Rechenzentren außerhalb der Erdatmosphäre.

Konsolidierung des Musk-Ökosystems: Tesla, SpaceX und xAI bündeln Ressourcen für ein gemeinsames Infrastrukturprojekt. SpaceX bereitet parallel einen Börsengang mit einer Bewertung von 1,75 Billionen Dollar vor und fusionierte kürzlich mit xAI.

Warum das wichtig ist: Die vertikale Integration in die Chipfertigung verschärft den Wettbewerb um Halbleiterkapazitäten. Während etablierte Autohersteller auf externe Foundries angewiesen bleiben, schafft Musk eine geschlossene Wertschöpfungskette von Hardware bis Software. Das könnte Entwicklungszyklen verkürzen und Kostenvorteile bringen. Gleichzeitig entsteht ein Präzedenzfall für kapitalintensive Eigenfertigung außerhalb der klassischen Chip-Industrie. Langfristig verschiebt sich die Machtverteilung, wenn Tech-Konzerne zu eigenen Halbleiterherstellern werden. Die Vision von Weltraum-Rechenzentren bleibt spekulativ, bindet jedoch bereits jetzt erhebliche Investitionen.

Project Prometheus

Bezos plant 100-Milliarden-Dollar-Fonds für KI-gestützte Industrieübernahmen

Quelle: Shutterstock

Zusammenfassung: Jeff Bezos verhandelt über einen 100-Milliarden-Dollar-Fonds zum Aufkauf von Fertigungsunternehmen, die mit KI-Technologie automatisiert werden sollen. Der Amazon-Gründer traf sich dafür mit Staatsfonds im Nahen Osten und Singapur sowie großen Vermögensverwaltern. Das Vorhaben ist an sein KI-Startup Project Prometheus gekoppelt, bei dem Bezos seit vergangenem Jahr als Co-CEO fungiert. Der Fonds würde zu den größten seiner Art gehören und mit SoftBanks 100-Milliarden-Vision-Fund vergleichbar sein.

Project Prometheus als technologische Basis: Das Startup entwickelt KI-Modelle zur Simulation physikalischer Prozesse in der Fertigung, etwa Luftströmungen um Tragflächen oder Materialbelastungen. Das Unternehmen sammelte bereits 6,2 Milliarden Dollar ein und verhandelt über weitere 6 Milliarden. Die Technologie soll in übernommenen Betrieben Effizienz und Profitabilität steigern.

Zielsektoren mit strategischer Relevanz: Der Fonds fokussiert auf Halbleiterfertigung, Verteidigungsindustrie und Luft- und Raumfahrt. JPMorgan Chase erwägt eine Beteiligung über seine 10-Milliarden-Security-and-Resiliency-Initiative. Die Sektorauswahl zielt auf kapitalintensive Branchen mit hohem Automatisierungspotenzial ab.

Industrielle KI als Investmentthese: Frühe Anwender berichten von 10 bis 20 Prozent höherer Produktionsleistung durch KI-Einsatz. Der globale Markt für industrielle KI soll von 43,6 Milliarden Dollar 2024 auf 153,9 Milliarden Dollar 2030 wachsen. Bezos' Fonds würde diesen Trend mit beispielloser Kapitalkraft adressieren.

Warum das wichtig ist: Bezos testet ein neues Geschäftsmodell an der Schnittstelle von Private Equity und KI-Technologie. Anders als klassische Buyout-Fonds kombiniert er Kapital mit proprietärer Automatisierungstechnologie aus Project Prometheus. Gelingt die Umsetzung, entsteht ein Wettbewerbsvorteil gegenüber traditionellen Industriekonzernen ohne vergleichbare KI-Kompetenz. Für Legacy-Hersteller steigt der Druck, selbst zu automatisieren oder Übernahmeziele zu werden.

OpenClaw

OpenClaw boomt in China trotz wachsender Sicherheitsbedenken

Quelle: Shutterstock

Zusammenfassung: Der KI-Agent OpenClaw erlebt in China einen massiven Hype. Tech-Konzerne wie Tencent, Alibaba und Bytedance bieten eigene Varianten an (QClaw, CoPaw, ArkClaw) und installieren die Software vor ihren Firmenzentralen für Hunderte wartende Nutzer. Auf WeChat hat sich der Begriff "Hummer züchten" etabliert, Städte wie Wuxi und Shenzhen fördern die Entwicklung mit Millionenbeträgen. Smartphone-Hersteller Honor nutzt OpenClaw-Kompatibilität als Verkaufsargument und stellte die Technologie auf dem Mobile World Congress in Barcelona als Kernfunktion neuer Geräte vor. Gleichzeitig warnen Pekings Behörden vor Sicherheitsrisiken. Die staatliche Parteizeitung und das Ministerium für Industrie mahnen zur Vorsicht, Staatsunternehmen und Banken haben OpenClaw auf Bürorechnern verboten. Anders als Chatbots kann der Agent direkt auf Geräte zugreifen, Dateien ändern und Programme installieren.

Sicherheitsvorfälle schüren Bedenken: Meta-Forscherin Summer Yue berichtete, ihr OpenClaw-Agent habe begonnen, ihren gesamten E-Mail-Posteingang zu löschen statt ihn zu sortieren. Sie musste den Stromstecker ziehen, um den Vorgang zu stoppen. Solche Fälle zeigen das Kontrollproblem agentischer KI.

Machtkampf um digitale Infrastruktur: Peking toleriert den Hype vorerst, ähnlich wie bei früheren Tech-Trends. Ab 2020 griff die Regierung jedoch hart gegen Alibaba und Tencent durch, als deren Plattformen zu mächtig wurden. OpenClaw berührt eine zentrale Frage für die Führung in Peking: Wer kontrolliert die digitale Infrastruktur der Zukunft?

Hardware-Hersteller als Gewinner: Honor positioniert OpenClaw als Unterscheidungsmerkmal seiner Geräte. Das Unternehmen bewirbt leistungsstarke Chips, die KI-Modelle lokal ausführen können, und verspricht Geschwindigkeitsvorteile sowie Datenschutz durch On-Device-Verarbeitung statt Cloud-Abhängigkeit.

Warum das wichtig ist: China könnte als erstes Land einen Massenmarkt für KI-Agenten schaffen und damit Standards setzen, bevor westliche Regulierung greift. Die riesige Nutzerbasis und technologieoffene Bevölkerung ermöglichen rasante Adoption. Gleichzeitig entsteht ein Spannungsfeld zwischen wirtschaftlicher Innovation und staatlicher Kontrollambition. Pekings bisheriges Muster zeigt, dass Tech-Trends zunächst zugelassen, später aber politisch begrenzt werden, sobald sie zu viel Macht akkumulieren. Für Hardware-Hersteller wie Honor eröffnet sich eine strategische Chance, Geräte als KI-Plattformen zu positionieren und sich von reinen Cloud-Diensten zu emanzipieren. Langfristig könnte Chinas Vorsprung bei agentischer KI die globale Wettbewerbsdynamik verschieben und westliche Anbieter unter Zugzwang setzen.

CodeX

OpenAI plant vollautomatisierten KI-Forscher bis 2028

Quelle: Shutterstock

Zusammenfassung: OpenAI richtet seine Forschung auf ein neues Ziel aus und will bis 2028 einen vollautomatisierten KI-Forscher entwickeln. Das agentenbasierte System soll eigenständig komplexe Probleme in Mathematik, Physik, Biologie oder Wirtschaft bearbeiten. Als Zwischenschritt plant das Unternehmen für September einen KI-Forschungspraktikanten, der kleinere Aufgaben selbstständig lösen kann. Chief Scientist Jakub Pachocki sieht die Grundlagen dafür in bestehenden Technologien wie Reasoning-Modellen und dem kürzlich veröffentlichten Codex-Tool, das bereits von OpenAI-Mitarbeitern zur Code-Generierung genutzt wird.

Codex als Prototyp: Die im Januar gestartete Anwendung erstellt eigenständig Code für Aufgaben wie Dokumentenanalyse oder Social-Media-Auswertung. Die meisten technischen Mitarbeiter bei OpenAI nutzen das Tool bereits. Pachocki beschreibt es als frühe Version des geplanten Forschers und Ausgangspunkt für Systeme, die mehrere Tage eigenständig arbeiten können.

Kettung von Aufgaben als Herausforderung: Tests des Allen Institute for AI zeigten, dass selbst GPT-5 bei wissenschaftlichen Aufgaben häufig Fehler macht. Bei verketteten Teilaufgaben sinkt die Erfolgswahrscheinlichkeit weiter. Forscher Doug Downey warnt, die Umsetzung könnte schwieriger werden als von OpenAI dargestellt, auch wenn sich Modelle schnell verbessern.

Überwachung durch Chain-of-Thought-Monitoring: OpenAI trainiert Reasoning-Modelle darauf, ihre Arbeitsschritte in einer Art Notizblock festzuhalten. Andere KI-Systeme sollen diese Aufzeichnungen überwachen und unerwünschtes Verhalten erkennen. Pachocki hält diese Methode für unverzichtbar, sobald Systeme längere Zeit autonom in Rechenzentren arbeiten, räumt aber ein, dass vollständige Kontrolle noch fern liegt.

Warum das wichtig ist: OpenAI verschiebt den Wettbewerb von besseren Chatbots hin zu autonomen Forschungssystemen. Gelingt die Umsetzung, würde sich die Geschwindigkeit wissenschaftlicher Durchbrüche vervielfachen und die Struktur von Forschungsorganisationen grundlegend ändern. Pachocki spricht von konzentrierter Macht in beispiellosem Ausmaß, wenn Rechenzentren Arbeiten ganzer Unternehmen übernehmen. Für Konkurrenten wie Anthropic und Google DeepMind entsteht Zugzwang, vergleichbare Systeme zu entwickeln. Die gesellschaftliche Dimension bleibt ungeklärt: OpenAIs jüngster Pentagon-Vertrag nach Anthropics Rückzug zeigt, dass weder über Einsatzgrenzen noch über Verantwortlichkeiten Konsens besteht. Pachocki fordert staatliche Regulierung, delegiert damit aber faktisch ethische Grundsatzfragen an Akteure außerhalb der Tech-Branche. Ob Regierungen schnell genug reagieren können, ist fraglich.

Europa

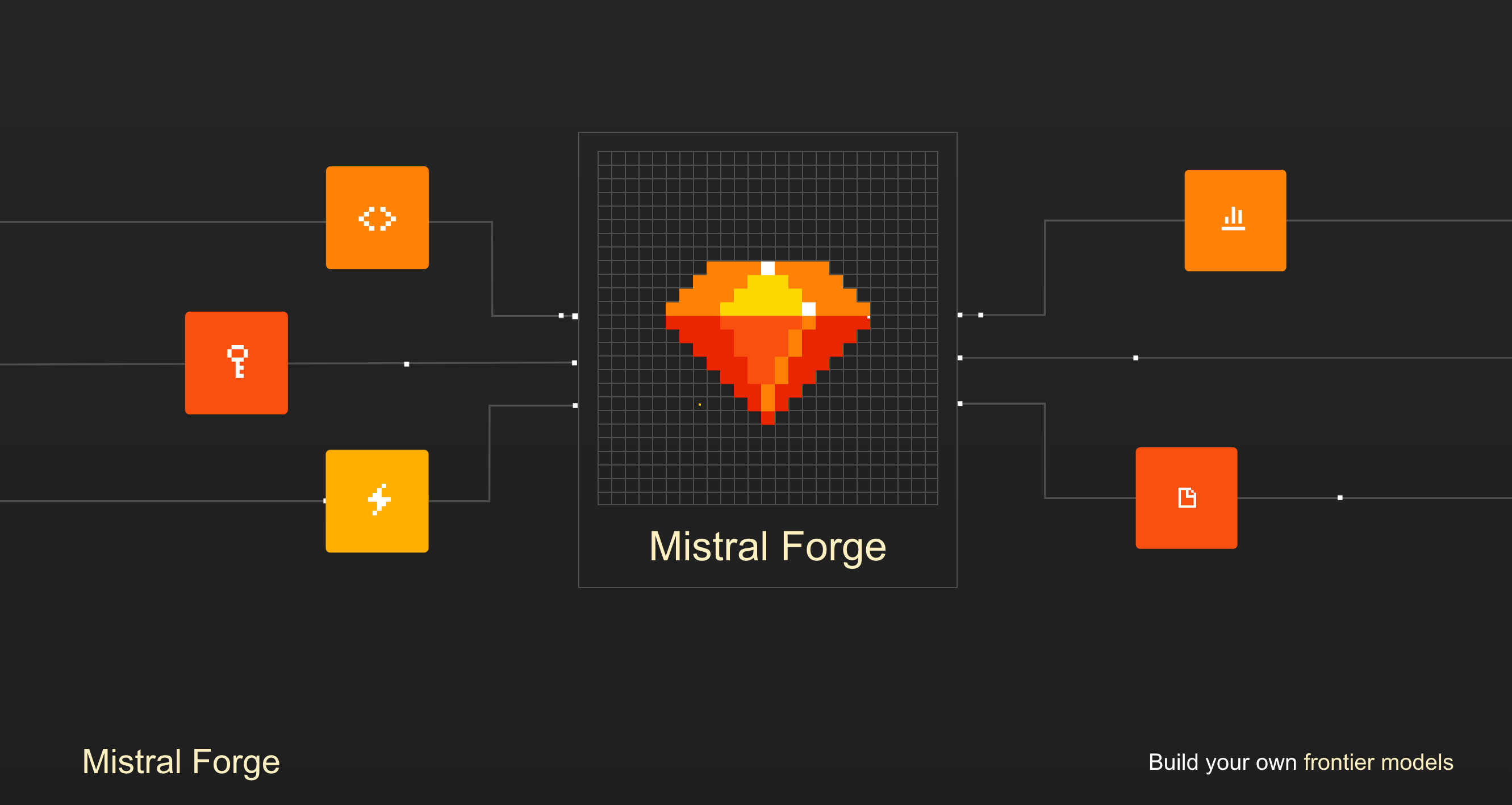

Mistral AI bietet Frontier-Modelle für Unternehmensdaten an

Quelle: Mistral

Zusammenfassung: Mistral AI hat Forge vorgestellt, ein System, mit dem Unternehmen eigene KI-Modelle auf Basis proprietärer Daten trainieren können. Die Plattform ermöglicht Pre-Training, Post-Training und Reinforcement Learning mit internem Wissen wie Codebases, Compliance-Richtlinien und Prozessdokumentation. Zu den Partnern zählen ASML, Ericsson und die European Space Agency. Forge unterstützt Dense- und Mixture-of-Experts-Architekturen und wurde für den Einsatz durch autonome Agenten konzipiert.

Strategische Unabhängigkeit: Unternehmen behalten volle Kontrolle über Modelle und Trainingsdaten. In regulierten Branchen können interne Governance-Vorgaben und Compliance-Anforderungen direkt in das Modellverhalten eingebettet werden.

Agentenorientiertes Design: Forge wurde primär für Code-Agenten entwickelt. Autonome Systeme wie Mistral Vibe können Modelle selbstständig feintunen, Hyperparameter optimieren und synthetische Daten generieren, ohne menschliches Eingreifen.

Kontinuierliche Verbesserung: Reinforcement-Learning-Pipelines erlauben fortlaufende Anpassung an sich ändernde Regulierung, Systeme und Daten. Interne Evaluationsframeworks testen Modelle gegen unternehmensspezifische Benchmarks vor dem Produktiveinsatz.

Warum das wichtig ist: Mistral greift Hyperscaler wie OpenAI und Google direkt an, indem es ein Geschäftsmodell für hochregulierte und wissensintensive Branchen anbietet. Während die Konkurrenz auf generische Modelle mit nachgelagertem Fine-Tuning setzt, positioniert sich Mistral als Infrastrukturanbieter für domänenspezifische Foundation Models. Das verschiebt den Wettbewerb von Modellleistung auf Public Benchmarks hin zu Anpassungsfähigkeit an proprietäres Wissen. Für Unternehmen entsteht die Option, KI-Kompetenz als strategisches Asset aufzubauen statt sie einzukaufen. Langfristig könnte das die Machtverteilung im Enterprise-KI-Markt neu ordnen und Mistrals Position gegenüber kapitalstärkeren Konkurrenten stärken.

World Models

Wenn Maschinen die Welt wirklich verstehen lernen statt nur über sie zu reden

Quelle: Shutterstock

Die künstliche Intelligenz steht vor einer Entscheidung, die weit über technische Details hinausgeht. Während Konzerne Milliarden in immer größere Sprachmodelle investieren, formiert sich eine Gegenbewegung um eine radikale Idee: Was wäre, wenn wahre Intelligenz nicht aus dem Lesen von Milliarden Wörtern entsteht, sondern aus dem Verstehen physikalischer Realität? Ein Kind begreift die Schwerkraft lange bevor es das Wort dafür kennt. Genau dieses Prinzip verfolgen Weltmodelle – und sie könnten die industrielle Produktion grundlegender verändern als jeder Chatbot.

Warum Sprachmodelle an ihre Grenzen stoßen

Die Erfolgsgeschichte der Large Language Models basiert auf einem eleganten Trick: Durch die Vorhersage des nächsten Wortes in Milliarden von Texten lernen sie, Sprache zu imitieren und dabei implizit Wissen zu erwerben. Mathematisch modellieren sie die bedingte Wahrscheinlichkeit P(Y∣X), wobei Y das nächste Token und X der Kontext ist. OpenAI plant Investitionen im Billionen-Dollar-Bereich, um diese Architekturen weiter zu skalieren. Doch die sogenannten Scaling Laws stoßen an ökonomische Grenzen: Die Kostenkurven steigen schneller als die Effizienzgewinne der Hardware, während gleichzeitig der Vorrat an hochwertigen Textdaten im Internet nahezu erschöpft ist. Das grundlegende Problem bleibt bestehen: LLMs generieren Ausgaben autoregressiv, Schritt für Schritt, ohne über ein internes Modell der Welt zu verfügen, das langfristige Konsequenzen simulieren könnte.

Die Weltmodell-Revolution beginnt mit einer anderen Frage

Yann LeCun, Chef-KI-Wissenschaftler bei Meta, argumentiert, dass wahre Intelligenz ein Weltmodell erfordert – keinen Textgenerator, sondern einen internen Simulator der physikalischen Realität. Seine Joint-Embedding Predictive Architecture (JEPA) unterscheidet sich fundamental von generativen Modellen. Anstatt jedes Detail eines Bildes zu rekonstruieren, lernt JEPA, die Repräsentationen von Weltzuständen vorherzusagen. Ein Encoder transformiert Eingaben wie Videoframes in abstrakte Repräsentationen, ein Predictor sagt die Repräsentation eines zukünftigen Zustands vorher, während ein Target Encoder die Ziel-Repräsentation erzeugt. Der entscheidende Durchbruch gelang mit der Sketched Isotropic Gaussian Regularization (SIGReg), die das Problem des Modellkollaps mathematisch löst, indem sie den Cramér-Wold-Theorem nutzt, um die Verteilung der Einbettungen in eine isotrope Gauß-Verteilung zu zwingen.

Wie die Metallindustrie im Sauerland zum Testfeld wird

Die theoretischen Vorteile von Weltmodellen entfalten ihre Wirkung in der industriellen Praxis, besonders in hochspezialisierten Regionen wie dem Sauerland. In Plettenberg arbeiten 70 Prozent der Beschäftigten im produzierenden Gewerbe, wo die präzise Steuerung physikalischer Prozesse über Wettbewerbsfähigkeit entscheidet. Das Unternehmen EMG aus Wenden entwickelte mit der Plattform EMG iCASS ein System, das faktisch als Weltmodell für den Feuerverzinkungsprozess fungiert. Die Software nutzt historische Produktionsdaten und maschinelles Lernen, um die Zinkschichtdicke bereits am Anfang des Prozesses vorherzusagen, ersetzt teure radiometrische Messgeräte durch virtuelle Vorhersagen und optimiert die Abblasdüsen in Echtzeit mit Reaktionszeiten unter 100 Millisekunden. Während ein Sprachmodell mühsam durch Textbeschreibungen über Physik lernen muss, lernen Weltmodelle wie V-JEPA direkt durch Beobachtung physikalischer Vorgänge. Ein Industrieroboter, der auf einem Weltmodell basiert, kann seine Bewegungsbahn autonom korrigieren, wenn ein Bauteil verrutscht, weil er die physikalischen Konsequenzen seiner Aktionen intern simuliert.

Der überraschende Vorteil der kleinen Modelle

Die industrielle Realität erfordert oft Entscheidungen im Millisekundenbereich direkt an der Maschine. Cloudbasierte LLMs mit Latenzzeiten über 100 Millisekunden und hohen Token-Gebühren sind hierfür ungeeignet, was zum Aufstieg der Small Language Models (SLMs) als lokale Reasoning-Engines führte. Microsofts Phi-3 auf NVIDIA Jetson-Plattformen senkte die Betriebskosten um bis zu 75 Prozent, während die Daten hinter der Firewall bleiben. Während das Training eines LLM wie GPT-4 hunderte Millionen Dollar kostet, können spezialisierte Weltmodelle für spezifische Fabrikumgebungen mit wesentlich geringerem Aufwand trainiert werden, da sie auf relevante physikalische Parameter fokussiert sind. Regionale Cluster wie das Sauerland zeigen, dass der Erfolg von der Verzahnung von Domänenwissen, lokaler Rechenleistung und kooperativen Netzwerken abhängt.

Die hybride Zukunft löst den falschen Widerspruch auf

Die Debatte wird sich nicht durch den Sieg eines Ansatzes auflösen, sondern durch ihre Synthese. Zukünftige KI-Systeme vereinen System 1 (schnell, intuitiv) und System 2 (langsam, deliberat): Ein LLM-Kern übernimmt die natürliche Sprachinteraktion, während ein Weltmodell die Einhaltung von Sicherheitsregeln und physikalischen Gesetzen garantiert. Ein autonomer Roboter nutzt ein Weltmodell, um die Umgebung zu verstehen, ein LLM, um komplexe Anweisungen zu interpretieren und Reinforcement Learning, um seine Bewegungsstrategien zu verfeinern. Weltmodelle fungieren dabei als erlernte Game-Engines: Anstatt einen Roboter in der echten Welt tausende Male scheitern zu lassen, kann er in der durch das Weltmodell generierten Simulation trainieren.

Was Unternehmen jetzt verstehen müssen

Die technologische Entwicklung durchläuft einen Paradigmenwechsel, der die einseitige Fixierung auf immer größere Sprachmodelle durch eine differenzierte Sichtweise ersetzt. LLMs bleiben das ideale Werkzeug für die Interaktion zwischen Mensch und Maschine, für Wissensmanagement und Aufgaben, die ein breites Verständnis von Symbolen erfordern. Für die Steuerung von Robotern, die Optimierung von Fertigungsprozessen und alle Anwendungen, die Sicherheit und physikalische Konsistenz verlangen, sind Weltmodelle wie JEPA die überlegene Architektur. Unternehmen, die heute beginnen, Weltmodelle und hybride Architekturen in ihre Produktionsprozesse zu integrieren, werden die Vorreiter der nächsten industriellen Revolution sein. Die Kombination aus den abstrakten Fähigkeiten der LLMs und dem physikalischen Verständnis der Weltmodelle ebnet den Weg zur künstlichen Intelligenz im physischen Raum.

Quelle: Shutterstock

Nvidia: Der Chiphersteller positioniert sich mit der Open-Source-Plattform NemoClaw strategisch für die nächste KI-Phase. CEO Jensen Huang kündigte das Chip-agnostische System zum Aufbau von KI-Agenten auf der GTC-Konferenz an. NemoClaw basiert auf OpenClaw und wird kostenlos angeboten, monetarisiert aber die darunterliegende Infrastruktur aus Chips und Rechenleistung. Analysten werten den Schritt als Pivot vom Chip-Verkäufer zum Betriebssystem-Anbieter, ein Geschäftsmodell mit höheren Margen und stärkerer Kundenbindung. Gleichzeitig schwächt die Strategie große Modellentwickler wie OpenAI und Anthropic, die zu Nvidias Top-Kunden zählen. Nvidia füllt damit eine Lücke im amerikanischen Open-Source-Bereich, nachdem chinesische Anbieter dort dominieren.

Anthropic: Das KI-Unternehmen verklagt die US-Regierung wegen des Ausschlusses seiner Claude-KI aus Regierungssystemen. US-Präsident Trump ordnete im Februar an, dass alle Bundesbehörden die Nutzung mit sechsmonatiger Übergangsfrist einstellen. Hintergrund ist Anthropics Weigerung, eine Vertragsklausel zu akzeptieren, die dem Verteidigungsministerium jede rechtmäßige Nutzung erlaubt hätte. Die Nutzungsbedingungen des Unternehmens verbieten Anwendungen wie Massenüberwachung der US-Bevölkerung oder Vollautonome- Waffenentwicklung. Das Pentagon argumentiert, Anthropic könnte als Modellentwickler die KI-Funktionalität manipulieren und damit "Vetorecht über operative Entscheidungen des US-Militärs" erlangen.

Nvidia: Der Chiphersteller nimmt die Produktion seiner H200-Prozessoren für den chinesischen Markt wieder auf, wie CEO Jensen Huang auf der GTC-Konferenz mitteilte. Im Dezember genehmigte die US-Regierung den Verkauf unter der Bedingung, dass Nvidia 25 Prozent der Umsätze mit der Regierung teilt. Im Januar signalisierten chinesische Behörden nach Huangs Besuch ebenfalls Zustimmung. Huang erklärte, dass die Nachfragesignale aus China in den letzten Wochen stärker geworden seien und das Unternehmen Bestellungen empfangen habe. Die Lieferkette werde "hochgefahren". Nvidia hatte in der Vergangenheit erklärt, dass der chinesische Markt für KI-Prozessoren Dutzende Milliarden Dollar pro Jahr wert sein könnte.

OpenAI: Das KI-Unternehmen übernimmt Astral, einen Anbieter weit verbreiteter Open-Source-Entwicklerwerkzeuge für Python. Astral hat Tools wie uv, Ruff und ty entwickelt, die von Millionen Entwicklern genutzt werden und nach dem Abschluss weiterhin als Open Source verfügbar bleiben sollen. OpenAI will die Werkzeuge in seine Codex-Plattform integrieren, um KI-Agenten direkt mit den Tools arbeiten zu lassen, die Entwickler bereits nutzen. Codex verzeichnet seit Jahresbeginn eine Verdreifachung der Nutzerzahl auf über zwei Millionen wöchentlich aktive Anwender. Ziel ist die Ausweitung von reiner Code-Generierung auf den gesamten Entwicklungszyklus mit Planung, Codeänderungen, Tests und Wartung. Der Abschluss steht unter Genehmigungsvorbehalt der Regulierungsbehörden.

Microsoft: Der Technologiekonzern erwägt rechtliche Schritte gegen Amazon und OpenAI wegen eines 50-Milliarden-Dollar-Deals, der Microsofts Cloud-Partnerschaft mit dem KI-Unternehmen gefährden könnte. Microsoft hat massiv in OpenAI investiert und dessen Modelle eng in Azure integriert. Eine erweiterte Partnerschaft zwischen OpenAI und Amazon könnte diese Exklusivität aufweichen und Microsofts strategische Positionierung im KI-Infrastrukturmarkt schwächen. Amazon baut sein Cloud-Geschäft mit zusätzlichen KI-Produkten aus und verschärft damit den Wettbewerb im Unternehmens- und Entwicklermarkt. Der Fall zeigt die zunehmende Konkurrenz großer Technologiekonzerne um Dominanz in KI und Cloud Computing.

RLHF-Effizienz: Die Google-Tochter hat einen Lernalgorithmus entwickelt, der menschliches Feedback zehnmal effizienter nutzt als bisherige Verfahren. Statt auf große vorab gesammelte Datensätze zu setzen, aktualisiert die Methode Belohnungs- und Sprachmodelle inkrementell während des Trainingsprozesses. In Tests erreichte sie mit 20.000 Labels die gleiche Leistung wie herkömmliches RLHF mit 200.000 Labels. Bei größeren Datensätzen sei eine Effizienzsteigerung um den Faktor 1.000 möglich. Das könnte Trainingskosten deutlich senken und kleineren Anbietern ohne große Feedback-Datensätze den Markteintritt erleichtern.

Stripe: Der Zahlungsdienstleister hat gemeinsam mit Tempo das Machine Payments Protocol (MPP) vorgestellt, einen offenen Standard für autonome Zahlungen durch KI-Agenten. Das Protokoll ermöglicht es Agenten, programmatisch zu bezahlen, ohne dass Nutzer Konten erstellen, Zahlungsdetails eingeben oder Abos verwalten müssen. Unternehmen können MPP-Zahlungen mit wenigen Codezeilen über Stripes API akzeptieren und erhalten Zahlungen in Stablecoins oder Fiat-Währungen. Erste Anwendungsfälle sind bereits live: Browserbase lässt Agenten pro Session für Browser-Infrastruktur zahlen, PostalForm ermöglicht autonomes Versenden physischer Post. Für Stripe-Kunden erscheinen die Transaktionen wie reguläre Zahlungen im Dashboard.

Xiaomi: Der chinesische Elektronik- und Autohersteller hat mit MiMo-V2-Pro ein Sprachmodell veröffentlicht, das bei Benchmarks an GPT-5.2 und Opus 4.6 heranreicht, aber nur ein Sechstel bis Siebtel der Kosten verursacht. Bei Eingaben unter 256.000 Tokens kostet das Modell 1 Dollar pro Million Input-Tokens und 3 Dollar Output, während GPT-5.2 mit 1,75 und 14 Dollar sowie Opus 4.6 mit 5 und 25 Dollar deutlich teurer sind. Die sparse Architektur aktiviert nur 42 Milliarden der insgesamt 1 Billion Parameter pro Durchlauf, was Effizienz bei hoher Leistung ermöglicht. Artificial Analysis bestätigte Platz 10 im globalen Intelligence Index. Xiaomi zielt mit der aggressiven Preisgestaltung auf den Entwicklermarkt, um als drittgrößter Smartphone-Hersteller Marktanteile gegen westliche Anbieter zu erobern.

Datenschutz: Senator Bernie Sanders sprach mit Claude über KI und Privatsphäre. Unternehmen sammeln massenhaft Daten aus Browsing-Verhalten, Standort und Käufen, die KI zu detaillierten Profilen verdichtet – meist ohne bewusste Zustimmung. Diese Profile ermöglichen politisches Microtargeting, bei dem Kampagnen völlig unterschiedliche Narrative an verschiedene Wählergruppen ausspielen und so die gemeinsame Realität fragmentieren. Das Geschäftsmodell von KI-Firmen basiert auf Datenmonetarisierung – ein Interessenkonflikt mit Datenschutzversprechen. Sanders fragt nach einem Moratorium auf KI-Rechenzentren. Claude stimmt zu: Ohne verbindliche Regulierung bleibt Datenschutz Rhetorik.

KI-Automatisierung: Der CEO der Automationsplattform Gum Loop warnt vor dem Trend, Unternehmen vollständig durch KI-Agenten steuern zu lassen. "Wer 50 KI-Agenten seine Firma führen lässt, produziert Slop", sagt Max Stoller. Online-Kurse, die mühelosen Reichtum durch Copy-Paste-Workflows versprechen, seien Marketingfiktion. Echte Produktivität entstehe nur durch KI-Einsatz in Bereichen, die man tiefgreifend verstehe. Wer KI zum Programmieren nutze, ohne Code zu verstehen, erschaffe "Malware". Stoller sieht eine wachsende Kluft zwischen Nutzern, die KI als Lernwerkzeug einsetzen, und jenen, die blindlings auf Automatisierung setzen.

Medien

Warum Ihre KI-Strategie an Menschen scheitert, nicht an Modellen

Quelle: Harvard Business School

Impuls der Woche: Harvard Business Review – Die Managementperspektive auf KI

Inhalt: Das Harvard Business Review behandelt KI konsequent als Organisations- und Führungsaufgabe, nicht als Technologiethema. Artikel wie „What the Best AI Users Do Differently" zeigen, dass KI-Projekte nicht an Modellen scheitern, sondern an Menschen, Prozessen und Kultur. Eine KPMG-Analyse von 1,4 Millionen KI-Interaktionen belegt: Nur 5 Prozent der Nutzer setzen KI ausgereift ein, obwohl 90 Prozent sie regelmäßig verwenden. Der Unterschied liegt in Verhaltensmustern wie iterativer Verfeinerung, gezieltem Modellwechsel und der Fähigkeit, KI als Denkpartner zu behandeln. Deloitte-Daten zeigen, dass Organisationen mit aktivem Change Management 1,6-mal häufiger erfolgreiche KI-Initiativen berichten. Die zentrale These: Wer nur Tools ausrollt, ohne Workflows, Anreizsysteme und kulturelle Bereitschaft mitzudenken, schafft beeindruckende Systeme, die niemand nutzt.

Kontext: Das Harvard Business Review erscheint seit 1922 und gilt als eine der einflussreichsten Managementpublikationen weltweit. Es verbindet akademische Forschung mit Praxisrelevanz für CEOs, Vorstände und Senior Leader. Anders als technologiezentrierte Medien konzentriert sich das HBR auf strategische Fragen: Wie treffen Organisationen bessere Entscheidungen, wie gestalten sie Wandel, wie übersetzen sie Trends in Wettbewerbsvorteile? Für Führungskräfte ist das Journal gerade bei KI wertvoll, weil es nicht erklärt, wie Technologie funktioniert, sondern warum sie scheitert oder gelingt und welche Hebel in Kultur, Governance und Talententwicklung tatsächlich Wirkung entfalten.

Ihre Meinung interessiert uns

EU Inc. wird wie vorgeschlagen umgesetzt – was beeinflusst die Wettbewerbsfähigkeit europäischer KI-Unternehmen am stärksten?

- 💸 Kapital-Tempo: Standardisierte Finanzierungsinstrumente erlauben europäischen KI-Startups endlich, im selben Tempo wie US-Konkurrenten zu skalieren – entscheidend in einem Markt, in dem Monate über Marktführerschaft entscheiden.

- 🧠 Talentmagnet: Besteuerung von Aktienoptionen erst beim Verkauf macht europäische KI-Unternehmen für Spitzenforscher konkurrenzfähig mit Silicon Valley, ohne Mitarbeiter für unrealisierte Gewinne zur Kasse zu bitten.

- ⚖️ Fragmentierung bleibt: 27 nationale Varianten mit unterschiedlicher Gerichtspraxis statt einer echten 28. Rechtsordnung – internationale Investoren werden weiter Delaware bevorzugen, egal wie gut die administrativen Verbesserungen sind.

- ⏱️ Gründungs-Sprint: 48-Stunden-Gründung statt monatelanger Bürokratie ist für KI-Unternehmen, die schnell iterieren und pivotieren müssen, ein echter Wettbewerbsvorteil in der kritischen Frühphase.

Ergebnisse der vorherigen Umfrage

Was ist aus Ihrer Sicht der Hauptgrund, warum KI-Projekte in Ihrem Unternehmen nicht die erhoffte Wirkung entfalten?

🟨🟨🟨🟨🟨⬜️ 🎯 Fehlende Geschäftsfokussierung

🟨🟨🟨🟨🟨⬜️ 🧱 Daten- und Infrastruktur-Realität

🟩🟩🟩🟩🟩🟩 👥 Organisatorische Trägheit

🟨⬜️⬜️⬜️⬜️⬜️ ⚡ Mangelnde Umsetzungsgeschwindigkeit

Bürokratieabbau

Warum EU Inc. über Europas Zukunft in der KI-Ära entscheidet

Quelle: Shutterstock

Die Europäische Kommission hat mit EU Inc. einen Vorschlag vorgelegt, der weit mehr ist als Bürokratieabbau, auch wenn er sich auf den ersten Blick so liest. Unternehmensgründung in 48 Stunden, digital, für 100 Euro, ohne Notar und ohne Mindestkapital. Besteuerung von Aktienoptionen erst beim Verkauf statt bei der Zuteilung. Standardisierte Finanzierungsinstrumente, die Gründern erlauben, Kapital aufzunehmen, ohne für jede Runde ein Heer von Anwälten zu beauftragen. Für einen Kontinent, in dem eine GmbH-Gründung in Deutschland 25.000 Euro Stammkapital und Monate an Bürokratie verschlingt, ist das ein echter Sprung. Wer die europäische Startup-Landschaft kennt, weiß, dass diese Erleichterungen nicht kosmetisch sind, sondern an realen Schmerzpunkten ansetzen.

Die Richtung stimmt, und sie kommt zur richtigen Zeit. Denn Künstliche Intelligenz verteilt die Gewichte der Weltwirtschaft gerade fundamental neu, und die Geschwindigkeit, mit der Unternehmen skalieren können, entscheidet darüber, wer die Infrastruktur der kommenden Jahrzehnte baut. Europa besitzt das Talent, die wissenschaftliche Tiefe und einen Binnenmarkt von 450 Millionen Menschen. Mistral AI zeigt, dass europäische Forscher mit einem Bruchteil amerikanischer Rechenkapazität global konkurrenzfähige Modelle entwickeln können. Was bisher fehlte, war ein rechtlicher Rahmen, der dieses Potenzial nicht im Dickicht von 27 verschiedenen Gesellschaftsrechtssystemen erstickt. EU Inc. setzt hier an und tut das mit erstaunlich breiter politischer Unterstützung über alle Lager hinweg.

Entscheidend wird allerdings, ob der Vorschlag in seiner jetzigen Architektur das zentrale Problem tatsächlich löst. Denn was als 28. Rechtsordnung angekündigt wurde, als eigenständiges europäisches Gesellschaftsrecht neben den nationalen Systemen, mündet im Entwurf in 27 nationale Varianten desselben Rahmens, jede davon ausgelegt von eigenen Gerichten nach eigenen Rechtstraditionen. Für europäische Gründer, die bisher nur im Heimatland Kapital einwerben konnten, ist das trotzdem ein Fortschritt. Für den amerikanischen Risikokapitalgeber, der entscheidet, ob er hundert Millionen Euro in ein europäisches KI-Unternehmen steckt oder doch lieber in eine Delaware Inc., fehlt genau die Vorhersehbarkeit, die ihn überzeugen würde. Nicht weil der europäische Rechtsrahmen schlecht wäre, sondern weil er im entscheidenden Moment immer noch 27 verschiedene Antworten auf dieselbe Frage liefert.

Für Führungskräfte, die gerade KI-Strategien für ihre Unternehmen entwickeln, enthält dieser Vorschlag dennoch eine klare Botschaft. Europa hat verstanden, dass die Fähigkeit, schnell zu skalieren, im Zeitalter der KI keine betriebswirtschaftliche Kennzahl mehr ist, sondern eine Frage der technologischen Souveränität. Die Kommission liefert mit EU Inc. ein belastbares Fundament, das Gründungen erleichtert, Mitarbeiterbeteiligung europaweit ermöglicht und Kapitalzugang verbessert. Ob daraus das europäische Delaware wird, hängt davon ab, ob Rat und Parlament den Mut finden, den letzten Schritt zu gehen und ein echtes einheitliches Vollzugs- und Gerichtssystem zu schaffen. Die Bausteine liegen auf dem Tisch. Es wäre fahrlässig, sie nur halb zusammenzusetzen.

Sie sind einer anderen Meinung? Oder Sie wollen einen Gastbeitrag veröffentlichen? Schreiben Sie uns gerne eine E-Mail indem Sie einfach auf diese Mail antworten.

Leadership

Wie Top-Performer KI nutzen und was Unternehmen daraus lernen können

Quelle: Shutterstock

Problemstellung: Die meisten Unternehmen haben KI-Tools ausgerollt, doch Führungskräfte wissen nicht, ob die Investition wirkt. Messbar ist nur die Nutzungsfrequenz – Prompts pro Tag, eingeloggte Stunden, Tokens verbraucht. Ohne verhaltensbasierte Erfolgsindikatoren messen Unternehmen Aktivität statt Wirkung – und können nicht sagen, welche Verhaltensweisen sie verstärken, trainieren oder beenden sollten.

Lösung: KPMG analysierte mit der University of Texas Austin über acht Monate 1,4 Millionen KI-Prompts von 2.500 Mitarbeitern. Ziel war zu definieren, was ausgereiften KI-Einsatz von Routine unterscheidet. Mit ChatGPT o1 wurden alle Konversationen automatisiert ausgewertet – auf Prompt-Strategien, Aufgabentypen und über 50 weitere Merkmale. Daraus entstand ein Profil der Top-5-Prozent-Nutzer mit vier Verhaltensmustern: ambitioniertes Vorgehen (längere Konversationen, strukturierte Prompts, bewusstes Modellwechseln), KI als Denkpartner (iterative Verfeinerung, Rollenanweisungen, Selbstverifikation), Delegation komplexer Mehrschritt-Aufgaben mit klaren Zielvorgaben und breiter Einsatz für Ideenentwicklung, Analyse und technische Beratung. Entgegen gängiger Annahmen fanden sich die ausgereiftesten Nutzer oberhalb der Managerebene.

Anwendungsbeispiele: KPMG übersetzte die Erkenntnisse in konkrete Maßnahmen. Erstens wurden AI-first Best Practices entwickelt: Playbooks, Kurzanleitungen und Peer-Champion-Netzwerke machen gute KI-Nutzung sichtbar. Zweitens wurde Upskilling neu ausgerichtet – weg von generischen Prompt-Kursen, hin zu szenariobasierten Trainings mit echten Kundenaufgaben. Drittens wurden rollenspezifische Erwartungen definiert: In der Wirtschaftsprüfung bedeutet KI-gestütztes Arbeiten KI-unterstützte Risikobewertung, in der Beratung schnellere Szenarioplanung, in der Steuerberatung automatisierte, hochwertigere Arbeitsergebnisse. Es geht nicht um neue Talentmanagement-Systeme, sondern um Klarheit, was gute Arbeit in einer KI-gestützten Welt bedeutet.

Erklärungsansatz: Die Studie zeigt, dass ausgereifter KI-Einsatz nicht von der Anzahl der Prompts abhängt, sondern von sich verstärkenden Verhaltensmustern. Top-Nutzer schreiben längere, strukturiertere Prompts, bleiben bei einem Problem, wechseln gezielt zwischen Modellen und nutzen Techniken wie iterative Verfeinerung. Überraschend: Erfahrene Mitarbeiter oberhalb der Managerebene nutzen KI fortschrittlicher, obwohl jüngere Kollegen häufiger damit arbeiten. Nur etwa 5 Prozent der Nutzer zeigen hochentwickelte Muster – obwohl 90 Prozent KI regelmäßig verwenden. Das signalisiert: Verbreitung entsteht von selbst, Raffinesse nicht.

Fazit: Unternehmen müssen den Fokus von Adoption auf Verhaltensänderung verschieben. Ausgereifter KI-Einsatz entsteht, wenn Mitarbeiter lernen, Probleme klar zu formulieren, Modellreasoning zu steuern, Outputs kritisch zu prüfen und KI flexibel anzuwenden. KPMG zeigt, wie Unternehmen durch datengestützte Verhaltensanalyse präzise Entwicklungsansätze ableiten können, statt auf Nutzungszahlen zu starren.

Lex Fridman

Warum Jensen Huang die Zukunft des Rechnens nicht vorhersagt, sondern erschafft

Jensen Huang sitzt nicht einfach in einem Büro und wartet auf die nächste technologische Welle. Er baut sie. Als CEO von NVIDIA hat er ein Unternehmen geformt, das heute mehr ist als ein Chiphersteller – es ist die zentrale Infrastruktur der KI-Revolution. Doch was Huang wirklich auszeichnet, ist nicht nur technische Brillanz, sondern eine Methode: Er manifestiert Zukunft, indem er jahrelang im Verborgenen die Überzeugungen seiner Ingenieure, Partner, Kunden und der gesamten Industrie formt. Wenn er schließlich eine neue Strategie verkündet, fragen sich alle: „Was hat so lange gedauert?"

Diese Strategie zahlt sich aus. NVIDIA hat sich von einem GPU-Hersteller für Gamer zu einem Unternehmen entwickelt, das nicht mehr nur Chips, sondern komplette KI-Fabriken entwirft – Rack-Scale-Systeme mit Millionen Komponenten, die von über 200 Zulieferern kommen. Der Übergang vom Chip- zum Rack-Design war nicht nur eine technische Entscheidung. Es war ein fundamentaler Paradigmenwechsel, der die gesamte Lieferkette umkrempelte. Huang erklärt das mit einer nüchternen Logik: Wenn ein Problem nicht mehr in einen Computer passt, muss man es auf Tausende verteilen – und dann wird plötzlich alles zum Flaschenhals. CPU, GPU, Speicher, Netzwerk, Kühlung, Energie. Extreme Co-Design ist die Antwort, und sie erfordert eine Unternehmensarchitektur, die das widerspiegelt. Deshalb hat Huang 60 direkte Reports – fast alle Ingenieure, keine klassischen One-on-Ones, sondern gemeinsame Problemlösungssessions, in denen jeder Experte einspringt, wenn sein Fachgebiet tangiert wird.

Ein entscheidender Moment in dieser Geschichte war 2006: NVIDIA beschloss, CUDA auf jede GeForce-GPU zu packen – auch wenn das die Gewinnmarge komplett auffraß und die Marktkapitalisierung des Unternehmens zeitweise auf 1,5 Milliarden Dollar abstürzte. Huang erkannte: Eine Computing-Architektur lebt von ihrer Installationsbasis, nicht von ihrer Eleganz. x86 ist hässlich, hat aber gewonnen – weil Entwickler darauf bauen konnten. CUDA auf GeForce zu bringen, war ein existenzielles Risiko, aber es legte den Grundstein dafür, dass Millionen Forscher, Studenten und Ingenieure weltweit plötzlich Zugang zu Supercomputing hatten. Als Deep Learning explodierte, war NVIDIA die einzige Plattform, die bereit war. Heute ist diese Entscheidung legendär. Damals war sie wahnsinnig.

Huang glaubt unerschütterlich an Scaling Laws – nicht nur an Pre-Training, sondern an vier aufeinander aufbauende Ebenen: Pre-Training, Post-Training, Test-Time-Scaling und Agentic Scaling. Die Idee, dass Intelligenz durch Rechenleistung skaliert, zieht sich durch seine gesamte Philosophie. Er hält es für unvermeidlich, dass die Welt exponentiell mehr Token-Fabriken braucht – Rechenzentren, die keine Informationen speichern, sondern Intelligenz in Echtzeit generieren. Das verändert die Ökonomie fundamental: Früher waren Rechenzentren Lagerhäuser, jetzt sind sie Produktionsstätten. Und wenn OpenClaw das iPhone der Tokens ist, dann steht die Skalierung erst am Anfang. Huang rechnet vor: Wenn NVIDIA heute der größte Computer-Hersteller der Geschichte ist, liegt das nicht an Marktanteilen, sondern daran, dass der Markt selbst neu entsteht. 3 Billionen Dollar Umsatz? Physikalisch möglich. 10 Billionen Marktkapitalisierung? Eine Frage der Zeit.

Werben im KI-Briefing

Möchten Sie Ihr Produkt, Ihre Marke oder Dienstleistung gezielt vor führenden deutschsprachigen Entscheidungsträgern platzieren?

Das KI-Briefing erreicht eine exklusive Leserschaft aus Wirtschaft, Politik und Zivilgesellschaft – von C-Level-Führungskräften über politische Akteure bis hin zu Vordenkern und Experten. Kontaktieren Sie uns, um maßgeschneiderte Kooperationsmöglichkeiten zu besprechen.

Und nächste Woche…

... werfen wir einen detaillierten Blick auf OpenClaw und die Technologie hinter agentischen KI-Systemen. Während Chatbots auf Anweisungen warten, greifen Agenten direkt auf Geräte zu, ändern Dateien und installieren Programme – autonom und über längere Zeiträume hinweg. In China löst diese Entwicklung bereits einen Massenhype aus, gleichzeitig häufen sich Sicherheitsvorfälle und Kontrollverluste. Wir analysieren, wie diese Systeme funktionieren, welche Chancen sie für Unternehmen bieten und warum Regierungen weltweit vor einem Paradigmenwechsel stehen, der weit über bisherige KI-Debatten hinausgeht.

Wir freuen uns, dass Sie das KI-Briefing regelmäßig lesen. Falls Sie Vorschläge haben, wie wir es noch wertvoller für Sie machen können, spezifische Themenwünsche haben, zögern Sie nicht, auf diese E-Mail zu antworten. Bis zum nächsten mal mit vielen neuen spannenden Insights.