Guten Morgen!

Willkommen zum KI-Briefing!

Die Münchner Sicherheitskonferenz hat einmal mehr unterstrichen, dass Europa seine technologische Souveränität entschlossener vorantreiben muss. Mit gezielten Investitionen, internationaler Zusammenarbeit und einem klaren politischen Kurs kann Europa eine eigenständige und starke Rolle in der Welt einnehmen.

Außerdem schleichen sich manchmal Fehler ein – und genau deshalb schätzen wir Ihr Feedback so sehr! In der letzten Ausgabe hatten wir fälschlicherweise geschrieben, dass DeepResearch Open Source von OpenAI stammt. Tatsächlich hat Hugging Face eine eigene Version entwickelt. Danke für den Hinweis – gemeinsam bleiben wir genau und verlässlich!

Wenn Sie unser KI-Briefing als Bereicherung für Ihren Führungsalltag empfinden, würden wir uns freuen, wenn Sie es an Kollegen, Mitarbeiter oder Vorgesetzte weiterempfehlen. Mit einer wachsenden Leserschaft können wir einzigartigere Inhalte schaffen, die einen direkten Mehrwert für alle bieten. Falls Sie diesen Newsletter weitergeleitet bekommen haben, können Sie sich ganz einfach hier anmelden.

Inhalt dieses Briefings

KI-News: OpenAI kündigt Vereinfachung der KI-Modelle an, Google präsentiert Gemini 2.0 Flash Thinking Experimental, Globale Impulse für verantwortungsvolle KI-Entwicklung, Glean führt Glean Agents ein und erweitert seine Work-AI-Plattform, Politische Werte von ChatGPT verändern sich messbar nach rechts, Vernetzung von Quantenprozessoren für skalierbare Supercomputer & Perplexity AI führt Deep Research ein

Deep Dive: Künstliche Intelligenz in den Wahlprogrammen zur Bundestagswahl 2025 🇩🇪

In aller Kürze: Elon Musk bietet 97,4 Milliarden Dollar für OpenAI und erhält eine spöttische Antwort von Sam Altman, JD Vance warnt in Paris vor strengen EU-KI-Regulierungen und betont US-Innovationsstrategie, Helsing und Mistral AI entwickeln KI-Modelle für die europäische Verteidigung, DeepMind übertrifft mit AlphaGeometry2 menschliche Spitzenmathematiker, Perplexity veröffentlicht ultraschnelles KI-Modell Sonar mit hoher Genauigkeit

Videos & Artikel: Andrej Karpathy erklärt die Entwicklung und Anwendung von Large Language Models in einem umfassenden Deep-Dive-Video, Sam Altman reflektiert in seinem Blog über den rasanten KI-Fortschritt, wirtschaftliche Dynamiken und gesellschaftliche Herausforderungen, Chief AI Scientist Yann LeCun sieht KI an Grenzen und erwartet technologischen Durchbruch, Trump und Musk setzen auf KI, um den öffentlichen Dienst umzustrukturieren & OpenAI entwickelt KI, die spezialisierte Programmieraufgaben automatisiert und Wettbewerbserfolge erzielt

Umfrage: Beeinflusst die Entwicklung rund um KI Ihre Wahlentscheidung bei der Bundestagswahl 2025?

Meinung: GPT-5 soll alles können aber genau das könnte zum Problem werden

Praxisbeispiel: Adobe Firefly Video Model macht hochwertige KI-Videos kommerziell sicher

YouTube: Das Geheimnis der Proteine und die Zukunft der Wissenschaft 🧑🔬

Cartoon: Wandel der Arbeit 😅

News

KI-Modelle

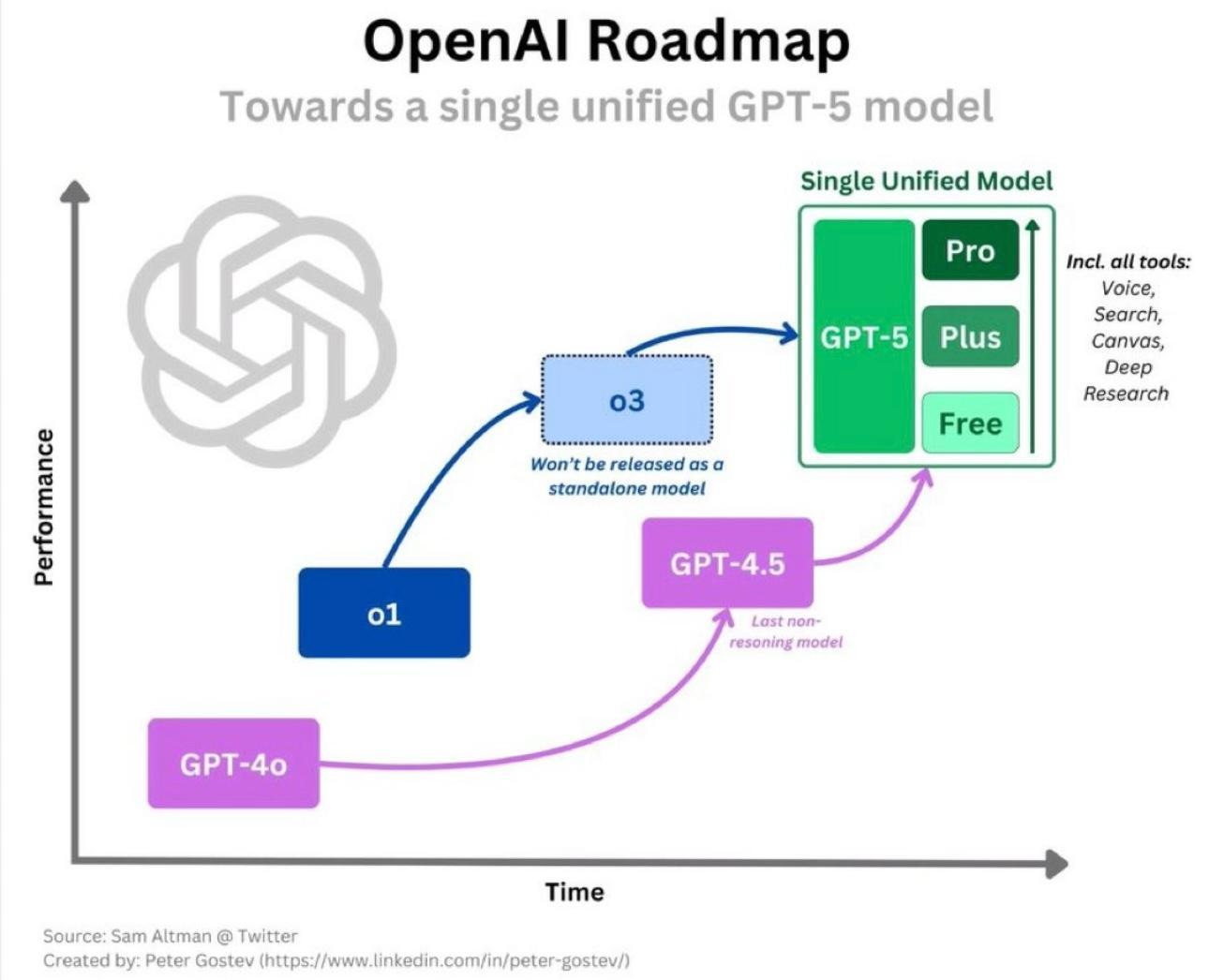

OpenAI kündigt Vereinfachung der KI-Modelle an

Zusammenfassung: OpenAI-CEO Sam Altman hat Pläne zur Vereinfachung der Produktpalette und zur Einführung neuer KI-Modelle bekanntgegeben. Das Unternehmen plant, zunächst GPT-4.5, intern "Orion" genannt, zu veröffentlichen, gefolgt von GPT-5, das verschiedene bestehende Technologien integrieren wird. Ziel ist es, die Nutzung der KI-Modelle für Anwender intuitiver und effizienter zu gestalten.

Einführung von GPT-4.5: Dieses Modell, bekannt als "Orion", wird das letzte von OpenAI sein, das ohne "Chain-of-Thought"-Prozesse arbeitet. Diese Technik ermöglicht es Modellen, komplexe Aufgaben durch schrittweises Denken besser zu bewältigen.

Integration bestehender Technologien in GPT-5: GPT-5 wird verschiedene bestehende Technologien, einschließlich des "o3"-Modells, vereinen, um ein umfassenderes und leistungsfähigeres KI-System zu schaffen. Das "o3"-Modell wird nicht mehr als eigenständiges Produkt angeboten.

Anpassung der ChatGPT-Zugangsmodelle: Kostenlose Nutzer von ChatGPT erhalten unbegrenzten Zugriff auf GPT-5 mit standardmäßiger Intelligenz. Plus-Abonnenten können GPT-5 auf einem höheren Intelligenzniveau nutzen, während Pro-Abonnenten Zugang zu noch fortschrittlicheren Funktionen haben werden. Diese Modelle werden Funktionen wie Sprachverarbeitung, erweiterte Recherche und mehr beinhalten.

Warum das wichtig ist: Die geplanten Änderungen von OpenAI zielen darauf ab, die Komplexität der aktuellen Produktpalette zu reduzieren und die Benutzerfreundlichkeit zu erhöhen. Durch die Integration verschiedener Technologien in GPT-5 und die Anpassung der Zugangsmodelle wird eine breitere Nutzerschaft erreicht und die Effizienz der KI-Anwendungen gesteigert. Dies könnte verändern, wie Menschen mit KI interagieren und den Zugang zu fortschrittlichen KI-Funktionen weiter demokratisieren.

Anzeige

Die Quintessenz des Weltgeschehens täglich als Newsletter oder in der App

Zusammenfassung: Whathappened bietet ein tägliches Morning Briefing, das die wichtigsten Nachrichten des Tages kuratiert, analysiert und dramafrei aufbereitet. Fünfmal wöchentlich fasst das Team die relevantesten Entwicklungen kompakt zusammen, ergänzt durch Analysen, Einschätzungen und wertungsarme Einordnungen. Die Plattform richtet sich an Menschen, die informiert bleiben möchten, ohne in Nachrichtenfluten unterzugehen – leserfreundlich, hochwertig und völlig unabhängig.

Das Konzept: Whathappened vereinfacht Nachrichtenkonsum durch gezielte Auswahl und analytische Mini-Artikel. Ziel ist es, komplexe Themen verständlich aufzubereiten und dennoch Tiefe zu bieten.

Globale und breite Berichterstattung: Themen wie Außenpolitik, Ökonomie, Klima und Technologie stehen im Fokus. Deutsche und europäische Nachrichten werden leicht priorisiert. Whathappened kuratiert dabei aus über 70 Quellen.

Komplett werbefrei: Als unabhängige Plattform wird das Briefing ausschließlich durch Mitgliedsbeiträge finanziert, wodurch ein sachlicher und unverfälschter Journalismus ermöglicht wird.

Warum wir es empfehlen: In einer Welt voller Informationsüberflutung bietet Whathappened einen dringend benötigten Anker. Es stellt sicher, dass Leser mit minimalem Zeitaufwand bestens informiert sind, ohne sich von reißerischen Schlagzeilen oder verzerrten Perspektiven beeinflussen zu lassen. Das Format fördert kritisches Denken und vermittelt einen klaren Blick auf die Welt. Wir schätzen die Qualität selbst sehr und haben ein besonderes Angebot für Sie: Neben dem kostenlosen Testmonat erhalten KI-Briefing-Leser mit dem Code “KIxWH” zwei zusätzliche Monate gratis.

KI-Modelle

Google präsentiert Gemini 2.0 Flash Thinking Experimental

Quelle: Google

Zusammenfassung: Google hat mit Gemini 2.0 Flash Thinking Experimental sein bislang leistungsstärkstes KI-Modell eingeführt. Dieses Modell zeichnet sich durch ein Zwei-Millionen-Token-Kontextfenster aus und ermöglicht die direkte Interaktion mit Diensten wie YouTube, Google Search und Google Maps. Zeitgleich hat das Unternehmen beschlossen, seine festen Ziele für Diversität, Gleichberechtigung und Inklusion (DEI) aufzugeben.

Erweitertes Kontextfenster: Mit einem Zwei-Millionen-Token-Kontextfenster kann das Modell umfangreiche Datenmengen effizient verarbeiten und komplexe Analysen durchführen.

Integration mit Google-Diensten: Die direkte Anbindung an YouTube ermöglicht es, Videos zu analysieren und präzise Zusammenfassungen zu erstellen. Zudem generiert das Modell strukturierte Antworten auf komplexe Suchanfragen in Google Search und unterstützt eine personalisierte Routenplanung in Google Maps.

Verfügbarkeit und Varianten: Neben der Hauptversion bietet Google auch Gemini 2.0 Flash-Lite als kosteneffiziente Alternative mit einem Eine-Million-Token-Kontextfenster an. Für anspruchsvolle Aufgaben steht das experimentelle Modell Gemini 2.0 Pro zur Verfügung, das speziell für Programmierung und komplexe Eingaben entwickelt wurde.

Warum das wichtig ist: Die Einführung von Gemini 2.0 Flash Thinking Experimental markiert einen wichtige Fortschritt in der KI-Entwicklung und könnte vielfältige Anwendungen in verschiedenen Branchen revolutionieren. Gleichzeitig wirft die Abkehr von festen DEI-Zielen Fragen zur sozialen Verantwortung von Technologieunternehmen auf. Diese Entwicklungen unterstreichen die Notwendigkeit, technologische Innovationen und gesellschaftliche Verantwortung in Einklang zu bringen, um nachhaltigen Fortschritt zu gewährleisten.

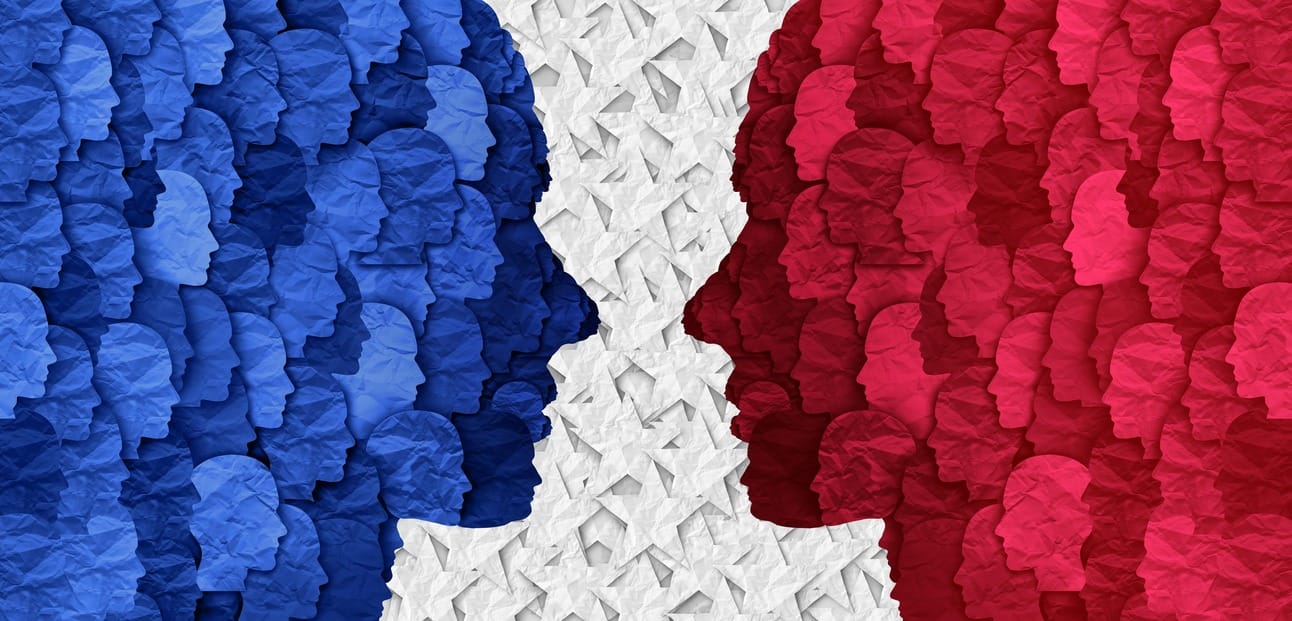

AI Action Summit 2025

Globale Impulse für verantwortungsvolle KI-Entwicklung

Zusammenfassung: Vom 6. bis 11. Februar 2025 versammelten sich in Paris Vertreter aus 60 Nationen, um die Zukunft der KI-Governance zu gestalten. Frankreich setzte mit einer umfassenden Erklärung zu inklusiver und nachhaltiger KI ein starkes Zeichen, doch die Ablehnung durch die USA und Großbritannien sorgte für Spannungen. Der Summit bot praxisnahe Einblicke in regulatorische Entwicklungen, ethische Herausforderungen und Innovationspotenziale, die für Unternehmen von strategischer Relevanz sind.

Frankreichs geopolitische Führungsrolle: Der Gipfel knüpfte an den Bletchley Park Safety Summit 2023 und den Seoul Summit 2024 an, ging aber mit einem umfassenderen Ansatz über reine Sicherheitsfragen hinaus. Frankreich positionierte sich als Brückenbauer zwischen technologischen Visionen und politischer Realität.

Neue Standards für Unternehmens-KI: Der Summit hob fünf zentrale Handlungsfelder hervor, darunter Public Service AI, Future of Work und Trust in AI. Besonders der französische Verwaltungs-KI-Prototyp „Albert“ demonstrierte, wie Transparenz und ethische Prinzipien konkret umgesetzt werden können.

Globale KI-Governance im Umbruch: Die Weigerung der USA und Großbritanniens, die Abschlusserklärung zu unterzeichnen, offenbarte tiefgreifende Unterschiede in der Regulierung. Während Europa auf strikte Compliance setzt, verfolgen anglo-amerikanische Länder eine flexiblere Selbstregulierung.

Warum das wichtig ist: Der Gipfel zeigte, dass die Zeit unregulierter KI-Entwicklung vorbei ist. Für Unternehmen bedeutet dies, dass KI-Strategien nicht nur auf technologische Effizienz ausgerichtet sein dürfen, sondern auch Governance, Ethik und gesellschaftliche Auswirkungen berücksichtigen müssen. Führungskräfte sollten sich frühzeitig auf neue regulatorische Rahmenbedingungen und ethische Standards vorbereiten.

Automatisierung

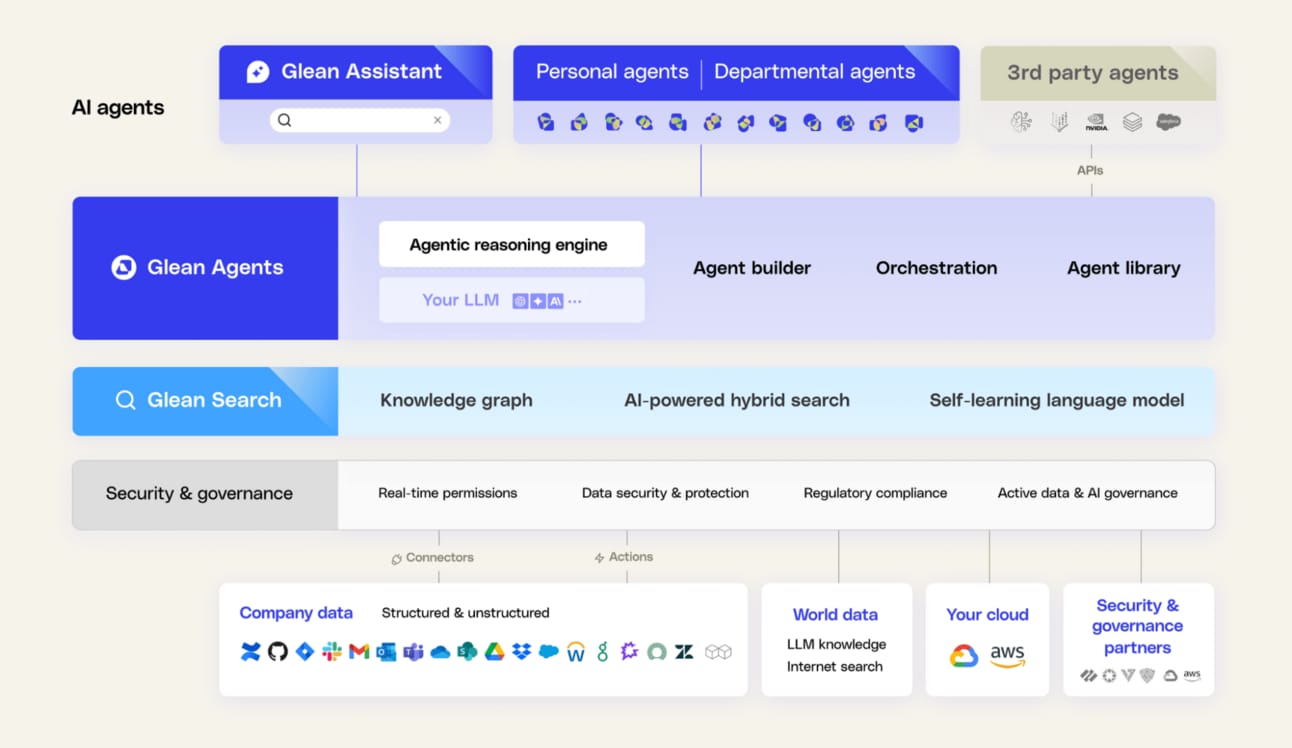

Glean führt Glean Agents ein und erweitert seine Work-AI-Plattform

Quelle: Glean

Zusammenfassung: Glean hat die Einführung von Glean Agents bekanntgegeben, einer Plattform, die es Unternehmen ermöglicht, maßgeschneiderte KI-Agenten zu erstellen und zu verwalten. Diese Entwicklung zielt darauf ab, die Produktivität zu steigern, indem sie den Zugriff auf sowohl unternehmensinterne als auch externe Wissensquellen integriert und automatisierte Arbeitsabläufe unterstützt.

Einführung von Glean Agents: Glean Agents bietet eine benutzerfreundliche Umgebung, in der Mitarbeiter ohne Programmierkenntnisse KI-Agenten erstellen können, die auf spezifische Geschäftsbedürfnisse zugeschnitten sind. Diese Agenten können in bestehende Kommunikationsplattformen wie Slack integriert werden und unterstützen die Automatisierung von Aufgaben.

Erweiterter Wissenszugriff: Die Plattform ermöglicht den Zugriff auf eine breite Palette von Datenquellen, einschließlich unternehmensinterner Anwendungen, Datenbanken und externer Informationen aus dem Internet. Dies unterstützt die Analyse von Echtzeitdaten und fundierte Entscheidungsfindung.

Aktive Daten- und KI-Governance: Glean Agents verfügt über Mechanismen zur proaktiven Überwachung und Verwaltung von Datenfreigaben, um sicherzustellen, dass sensible Informationen geschützt bleiben und nur autorisierten Benutzern zugänglich sind.

Warum das wichtig ist: Die Einführung von Glean Agents markiert einen bedeutenden Schritt in der Integration von KI in den Arbeitsalltag. Durch die Vereinfachung der Erstellung und Verwaltung von KI-Agenten können Unternehmen ihre Effizienz steigern und Mitarbeiter in die Lage versetzen, innovative Lösungen für komplexe Aufgaben zu entwickeln. Dies fördert nicht nur die individuelle Weiterentwicklung, sondern stärkt auch die kollektive Intelligenz einer Organisation.

Algorithmen & Bias

Politische Werte von ChatGPT verändern sich messbar nach rechts

Quelle: Shutterstock

Zusammenfassung: Eine neue Studie zeigt, dass ChatGPTs politische Werte über verschiedene Versionen hinweg einen signifikanten Rechtsruck durchlaufen haben. Mithilfe des Political Compass Tests und Bootstrapping-Methoden analysierten Forscher mehrere Versionen des Modells und stellten fest, dass ChatGPT zwar weiterhin im libertär-linken Spektrum bleibt, aber über Zeit hinweg nach rechts driftet. Die Ursachen sind unklar, könnten aber an Änderungen im Trainingsdatensatz, Nutzerinteraktionen oder algorithmischen Anpassungen liegen.

Messbare politische Verschiebung: Die Analyse von ChatGPT 3.5 und 4 ergab, dass spätere Versionen in wirtschaftlichen und sozialen Fragen signifikant weniger links eingestellt waren. Besonders ChatGPT 3.5 zeigte eine dreimal stärkere Rechtsverschiebung als GPT-4.

Mögliche Ursachen für den Wandel: Die Forscher vermuten, dass entweder Änderungen in den Trainingsdaten, Nutzerinteraktionen oder Anpassungen an der Moderationslogik diesen Wandel verursachen. Konkrete Erklärungen seitens OpenAI fehlen bislang.

Auswirkungen auf gesellschaftliche Debatten: Da LLMs zunehmend für Nachrichten, Bildung und Entscheidungsprozesse genutzt werden, könnten politische Tendenzen in KI-Modellen gesellschaftliche Diskurse beeinflussen. Experten fordern daher eine genauere Überwachung von Algorithmen, um ungewollte Verzerrungen zu vermeiden.

Warum das wichtig ist: Die Ergebnisse werfen zentrale Fragen zur Neutralität und Kontrolle von KI auf. Ein schleichender politischer Wandel in Sprachmodellen könnte langfristig die öffentliche Meinung beeinflussen und gesellschaftliche Spaltungen vertiefen. Besonders für Europa ist das ein kritisches Thema: Wenn zentrale KI-Modelle vorwiegend außerhalb des Kontinents entwickelt werden, laufen europäische Werte Gefahr, in der technologischen Gestaltung unterrepräsentiert zu sein. KI-Souveränität und Unabhängigkeit sind daher essenziell, um sicherzustellen, dass Künstliche Intelligenz nicht nur technologische, sondern auch kulturelle und gesellschaftliche Eigenheiten Europas berücksichtigt.

Quantencomputing

Vernetzung von Quantenprozessoren für skalierbare Supercomputer

Quelle: Shutterstock

Zusammenfassung: Wissenschaftler der Universität Oxford haben erstmals separate Quantenprozessoren zu einem vollständig vernetzten System verbunden. Dieser Meilenstein überwindet das Skalierbarkeitsproblem, indem kleinere Quantenmodule über photonische Verbindungen gekoppelt werden. Dies ermöglicht die Verteilung von Berechnungen auf mehrere Einheiten und ebnet den Weg für groß angelegte Quantencomputer.

Photonische Verbindungen als Schlüssel: Durch die Nutzung von optischen Fasern und Photonen zur Datenübertragung zwischen den Modulen können Qubits in getrennten Einheiten verschränkt werden. Dies erlaubt die Durchführung von Quantenlogikoperationen über verschiedene Module hinweg mittels Quantenteleportation.

Demonstration von Grovers Suchalgorithmus: Die Forscher führten erfolgreich Grovers Suchalgorithmus aus, der große, unstrukturierte Datensätze effizienter durchsucht als klassische Methoden. Dies unterstreicht das Potenzial des dezentralen Ansatzes, die Fähigkeiten von Quantencomputern zu erweitern.

Vergleich mit klassischen Supercomputern: Ähnlich wie traditionelle Supercomputer, die aus vernetzten kleineren Rechnern bestehen, ermöglicht dieser modulare Ansatz die Verteilung der Rechenlast und bietet Flexibilität für zukünftige Upgrades und Erweiterungen.

Warum das wichtig ist: Die erfolgreiche Vernetzung von Quantenprozessoren markiert einen entscheidenden Schritt hin zu skalierbaren und leistungsfähigen Quantencomputern. Dieser Fortschritt könnte die Lösung komplexer Probleme in Bereichen wie Kryptographie, Materialwissenschaften und künstlicher Intelligenz revolutionieren. Die modulare Architektur bietet zudem Flexibilität für zukünftige Entwicklungen und Anpassungen.

KI-Tools

Perplexity AI führt Deep Research ein

Zusammenfassung: Perplexity AI hat das Deep Research-Tool gestartet, das Nutzern ermöglicht, in wenigen Minuten umfassende Recherchen und Analysen durchzuführen. Das Tool durchsucht zahlreiche Quellen, analysiert die Informationen und erstellt eigenständig detaillierte Berichte. Deep Research ist kostenlos zugänglich, wobei Pro-Abonnenten unbegrenzte Anfragen stellen können. Es ist derzeit über die Webversion verfügbar und wird bald auf iOS, Android und Mac ausgerollt.

Autonome Recherche: Das Tool führt eigenständig mehrere Suchvorgänge durch, liest Hunderte von Quellen und erstellt einen umfassenden Bericht, der Aufgaben in Bereichen wie Finanzen, Marketing und Produktforschung abdeckt.

Berichtserstellung: Nach der Analyse der Quellen fasst Deep Research die Informationen in klaren und detaillierten Berichten zusammen, die exportiert und geteilt werden können.

Leistungsstarke Benchmarks: Deep Research erreicht eine Genauigkeit von 21,1 % im "Humanity’s Last Exam"-Benchmark, was über den Werten vieler führender Modelle liegt.

Warum das wichtig ist: Die Einführung von Deep Research ermöglicht es einer breiten Nutzerbasis, komplexe Analysen effizient durchzuführen und fundierte Entscheidungen zu treffen. Durch den kostenlosen Zugang wird der Einsatz fortschrittlicher KI-Technologie zugänglicher, was die Chancengleichheit im Zugang zu Wissen fördert und den Alltag von Fachleuten wie auch Laien erheblich erleichtern könnte.

Deep Dive

Quelle: Shutterstock

Künstliche Intelligenz in den Wahlprogrammen zur Bundestagswahl 2025

Künstliche Intelligenz hat sich in den letzten Jahren von einer technologischen Vision zu einer gesellschaftlichen Realität entwickelt. Unternehmen automatisieren Prozesse, Universitäten forschen an wegweisenden Anwendungen und der öffentliche Sektor testet KI-gestützte Lösungen. Doch während KI zunehmend unseren Alltag prägt, bleibt die politische Steuerung dieses Wandels eine offene Frage. Welche Weichenstellungen plant die Politik? Welche Regulierung braucht es, und welche Anreize werden geschaffen? Die Bundestagswahl 2025 könnte hier eine entscheidende Weichenstellung bringen.

Die SPD sieht Künstliche Intelligenz als Schlüsseltechnologie für Wirtschaft, Wissenschaft und Verwaltung, betont aber zugleich die Notwendigkeit klarer Regeln und sozialer Verantwortung. Ihr Ansatz ist ein Dreiklang aus Förderung von Innovation, Schutz von Arbeitnehmerrechten und Regulierung zur Wahrung demokratischer Werte. Sie setzt auf gezielte Investitionen in Forschung, branchenspezifische KI-Ökosysteme und den Einsatz von KI zur Effizienzsteigerung in Verwaltung und Gesundheitswesen. Gleichzeitig fordert sie Transparenzpflichten für KI-Modelle, Mitbestimmung bei der Einführung von KI am Arbeitsplatz und einen ethischen Rahmen, um Diskriminierung und Missbrauch zu verhindern. KI soll der Gesellschaft dienen – nicht umgekehrt.

Die CDU/CSU setzt auf eine innovationsfreundliche und wirtschaftsorientierte Entwicklung von Künstlicher Intelligenz. Sie sieht KI als entscheidenden Faktor für die Wettbewerbsfähigkeit Deutschlands und betont die Notwendigkeit einer starken digitalen Infrastruktur, insbesondere leistungsfähiger Rechenzentren. Der Fokus liegt auf der Förderung von Forschung und Anwendung in der Wirtschaft – insbesondere im Mittelstand –, wobei Bürokratie und Überregulierung abgelehnt werden. Die Partei setzt sich für eine pragmatische Umsetzung des EU AI Acts ein und möchte Freiräume für Innovationen schaffen. Zudem soll KI die Verwaltung effizienter machen und im notwendigen Rahmen von Sicherheitsbehörden genutzt werden

Bündnis 90/Die Grünen sehen Künstliche Intelligenz als eine Schlüsseltechnologie, die Innovationspotenzial für Wirtschaft, Wissenschaft und Verwaltung bietet. Sie setzen auf eine menschenzentrierte und nachhaltige KI-Entwicklung, die ethische Prinzipien, Datenschutz und gesellschaftliche Verantwortung in den Mittelpunkt stellt. Die Grünen wollen die Forschung und Anwendung von KI gezielt fördern, insbesondere im Mittelstand und an Hochschulen, und dabei Open-Source-Ansätze stärken. Gleichzeitig fordern sie klare Regeln zur Transparenz und Nachvollziehbarkeit von KI-Systemen, um Diskriminierung und Intransparenz zu verhindern. Ihr Ziel ist eine europäische KI-Strategie, die technologische Souveränität mit sozialer Gerechtigkeit verbindet und dabei Innovationen verantwortungsvoll steuert.

Die FDP sieht Künstliche Intelligenz als eine zentrale Zukunftstechnologie und verfolgt einen wirtschaftsfreundlichen, innovationsgetriebenen Ansatz. Ihr Ziel ist es, Deutschland zu einem der führenden KI-Standorte weltweit zu machen. Dabei setzt sie auf eine erleichterte Nutzung von Trainingsdaten, den Abbau regulatorischer Hürden und eine unternehmerfreundliche Umsetzung des AI Acts der EU. Forschung und Anwendung von KI sollen durch ein Forschungsdatengesetz und verbesserte digitale Infrastrukturen unterstützt werden. Gleichzeitig will die FDP KI gezielt in Verwaltung und Justiz einsetzen, um Prozesse zu optimieren, ohne jedoch richterliche Entscheidungen durch KI zu ersetzen. Sie verfolgt eine technologieoffene Strategie, die wirtschaftliche Chancen in den Mittelpunkt stellt und dabei möglichst wenig regulierend eingreift.

Die AfD erkennt das wirtschaftliche Potenzial von Künstlicher Intelligenz an, lehnt aber eine zentrale Steuerung durch die EU ab. Sie fordert nationale, praxisnahe Regelungen für den Einsatz von KI, insbesondere in Bereichen wie Medizintechnik und Verkehrswesen. Voraussetzung für den Erfolg von KI sei eine kostengünstige Energieversorgung, weshalb die Partei die Energiewende und hohe Strompreise als Innovationshemmnisse betrachtet. Gleichzeitig warnt sie vor Risiken durch KI, insbesondere für kritische Infrastruktur und bürgerliche Freiheiten. Die AfD spricht sich gegen umfassende EU-Regulierungen wie den AI Act aus und setzt stattdessen auf nationale Souveränität und technologische Offenheit

Die Linke steht dem Einsatz von Künstlicher Intelligenz skeptisch gegenüber und betont die Notwendigkeit einer strikten Regulierung, um soziale Gerechtigkeit, Datenschutz und Arbeitsrechte zu gewährleisten. Sie fordert eine stärkere demokratische Kontrolle über KI-Entwicklungen, insbesondere im öffentlichen Bereich, und lehnt eine Überwachung oder Diskriminierung durch KI ab. Der technologische Fortschritt soll in den Dienst des Gemeinwohls gestellt werden, anstatt wirtschaftlichen Interessen großer Konzerne zu dienen. Zugleich setzt sich die Partei für den Schutz von Arbeitnehmerrechten ein und warnt vor der Automatisierung, die Arbeitsplätze gefährden könnte.

Die Parteiprogramme zur Wahl geben Einblick in ihre jeweiligen Vorstellungen für die Zukunft künstlicher Intelligenz in Deutschland. Dabei geht es um zentrale Fragen: Wie soll Deutschland im internationalen Wettbewerb bestehen? Welche ethischen Leitplanken braucht es? Und wie wird sichergestellt, dass KI wirtschaftlichen Fortschritt bringt, ohne gesellschaftliche Ungleichheiten zu verschärfen?

In aller Kürze

Quelle: Shutterstock

OpenAI: Eine von Elon Musk angeführte Investorengruppe hat ein Übernahmeangebot über 97,4 Milliarden Dollar für OpenAI eingereicht. Musk begründet dies mit dem Wunsch, OpenAI wieder stärker auf Open-Source und Sicherheit auszurichten. OpenAI-CEO Sam Altman reagierte ironisch und bot im Gegenzug 9,74 Milliarden Dollar für X an. Musk, der OpenAI 2015 mitgründete und 2018 verließ, geht juristisch gegen das Unternehmen vor. Sein KI-Unternehmen xAI könnte nach einer möglichen Übernahme mit OpenAI fusionieren.

JD Vance: Vizepräsident JD Vance nutzte seinen ersten Auslandsbesuch, um europäische Regierungen vor zu strengen KI-Regulierungen zu warnen. Beim AI Action Summit in Paris betonte er, dass restriktive EU-Vorgaben Innovationen hemmen und US-Unternehmen benachteiligen könnten. Die USA setzen auf eine wachstumsfördernde Politik, um ihre technologische Führungsposition zu sichern. Trotz Kritik an europäischen Regeln zeigte sich Vance offen für internationale Kooperationen, sofern diese den Fortschritt nicht gefährden. Seine Rede unterstreicht die geopolitische Bedeutung der US-Innovationspolitik und mögliche Spannungen mit der EU.

Helsing & Mistral AI: Helsing und Mistral AI haben eine strategische Partnerschaft zur Entwicklung von KI-Systemen für die europäische Verteidigung angekündigt. Fokus der Zusammenarbeit sind Vision-Language-Action-Modelle, die Verteidigungsplattformen eine verbesserte Umgebungswahrnehmung, Kommunikation und Entscheidungsfindung ermöglichen. Die Kooperation vereint Helsings Expertise in militärischer KI mit Mistrals fortschrittlichen Sprachmodellen. Ziel ist es, Europas Technologieführerschaft in KI und Verteidigung zu stärken. Die Partnerschaft wurde beim Global AI Summit in Paris vorgestellt.

Google DeepMind: AlphaGeometry2 hat 84 % der Geometrieaufgaben der International Mathematical Olympiad der letzten 25 Jahre gelöst und damit den Durchschnitt eines Goldmedaillengewinners übertroffen. Das Modell kombiniert ein Gemini-Modell mit einer symbolischen Engine und erzielte 42 von 50 Punkten – ein deutlicher Fortschritt gegenüber den 54 % seines Vorgängers. Trainiert wurde es mit über 300 Millionen synthetischen Theoremen und Beweisen, die schrittweise komplexer wurden. Diese Entwicklung könnte auch wissenschaftliche Disziplinen wie die Physik voranbringen, die auf komplexer Mathematik basieren.

Perplexity: Das Unternehmen hat eine neue Version seines KI-Modells Sonar veröffentlicht, das auf Llama 3.3 70B basiert und mit einer Geschwindigkeit von 1.200 Tokens pro Sekunde antwortet. Sonar ist laut Tests schneller als Gemini 2.0 Flash und übertrifft GPT-4o sowie Claude 3.5 Sonnet in Genauigkeit und Nutzerzufriedenheit. Es steht nun allen Perplexity-Pro-Nutzern zur Verfügung, API-Zugang folgt ebenfalls bald. CEO Aravind Srinivas kündigte zudem einen Voice Mode an, der Echtzeit-Sprachantworten kostenlos liefern soll. Perplexity verstärkt damit seinen Wettbewerbsvorteil im KI-Markt.

Videos & Artikel

Andrej Karpathy: Der ehemalige OpenAI-Mitgründer und Tesla-AI-Direktor veröffentlicht ein umfassendes Deep-Dive-Video zu Large Language Models (LLMs). Darin erklärt er die gesamte Trainingspipeline dieser KI-Modelle, ihre Funktionsweise und mentale Modelle zur Interpretation ihres „Denkens“. Zudem gibt er praxisnahe Tipps zur optimalen Nutzung. Das Video soll das Verständnis für moderne KI-Technologien vertiefen und Anwender befähigen, sie effektiv einzusetzen. Karpathy baut derzeit mit Eureka Labs eine KI-native Schule auf.

Sam Altman: Sam Altman reflektiert in seinem Blog über den aktuellen Stand der KI-Entwicklung und ihre wirtschaftlichen Implikationen. Er identifiziert drei Kernbeobachtungen: KI-Intelligenz wächst mit den eingesetzten Ressourcen, die Nutzungskosten sinken rapide, und der wirtschaftliche Nutzen steigt überproportional. Langfristig erwartet er eine tiefgreifende Transformation der Gesellschaft, in der KI-Agenten als virtuelle Mitarbeiter agieren. Er betont die Bedeutung politischer Steuerung, um Ungleichheiten zu minimieren, und plädiert für eine breite Verfügbarkeit von KI, um deren Vorteile global zugänglich zu machen.

Yann LeCun: Der Chief AI Scientist von Meta, prognostiziert eine weitere Revolution in der künstlichen Intelligenz innerhalb der nächsten fünf Jahre. Er betont, dass aktuelle Systeme noch nicht ausgereift genug sind, um Haushaltsroboter oder vollständig autonome Fahrzeuge zu ermöglichen. Fortschritte seien notwendig, um eine tiefere physikalische Weltverständnis zu erreichen. LeCun wurde zusammen mit anderen KI-Pionieren mit dem renommierten Queen Elizabeth Prize for Engineering ausgezeichnet. Zeitgleich warnt Yoshua Bengio vor Sicherheitsrisiken und fordert mehr Verantwortung im Umgang mit der Technologie.

Trump und Musk: Die Regierung unter Donald Trump und mit Einfluss von Elon Musk setzt auf eine radikale Umstrukturierung des öffentlichen Dienstes. Zehntausende Beamte werden entlassen oder zum Rücktritt gedrängt, während KI-gestützte Systeme Regierungsaufgaben übernehmen sollen. Laut Washington Post analysiert Musks „Department of Government Efficiency“ (DOGE) bereits staatliche Daten mit KI, um Kosten zu senken – möglicherweise auf Kosten menschlicher Arbeitsplätze. Kritiker warnen, dass dies die Macht der Exekutive erheblich zentralisieren und demokratische Kontrollmechanismen schwächen könnte.

Softwareentwicklung: Die Studie “Competitive Programming with Large Reasoning Models”zeigt, dass Reinforcement Learning (RL) die Problemlösungsfähigkeiten großer Sprachmodelle in Programmierwettbewerben erheblich verbessert. Während das spezialisierte Modell o1-ioi mit heuristischen Strategien beim IOI 2024 unter lockeren Regeln Gold erreichte, übertraf o3 dies ohne domänenspezifische Anpassungen. Mit einer CodeForces-Bewertung auf Elite-Niveau zeigt o3, dass skalierbares RL klassische Methoden ersetzt. Dies unterstreicht das Potenzial KI-gestützter Softwareentwicklung, da selbst hochspezialisierte Aufgaben automatisiert werden können – mit tiefgreifenden Auswirkungen auf die IT-Branche und den Arbeitsmarkt.

Umfrage

Ihre Meinung interessiert uns

Beeinflusst die Entwicklung rund um KI Ihre Wahlentscheidung bei der Bundestagswahl 2025?

- 🗳️ Ja, stark: KI-Entwicklung ist eines der wichtigsten Themen für meine Wahlentscheidung.

- 🤔 Ja, etwas: KI spielt eine Rolle, aber andere Themen sind für mich wichtiger.

- 😐 Kaum: KI-Entwicklung beeinflusst meine Wahlentscheidung nur minimal.

- 🚫 Nein, gar nicht: Meine Wahlentscheidung wird durch KI-Entwicklung nicht beeinflusst.

Ergebnisse der vorherigen Umfrage

Welche der folgenden Themenbereiche sind für Ihre Entscheidungen am relevantesten?

🟨🟨🟨⬜️⬜️⬜️ 📌 Kontextwissen

🟨⬜️⬜️⬜️⬜️⬜️ 🖥️ Technologische Ebene

🟩🟩🟩🟩🟩🟩 🤖 Produkt Ebene

🟨🟨🟨⬜️⬜️⬜️ 👥 Future of Work

🟨⬜️⬜️⬜️⬜️⬜️ 🏢 Organisationsformen

Meinung der Redaktion

GPT-5 soll alles können aber genau das könnte zum Problem werden

Quelle: Eigene KI Illustration

OpenAI verspricht mit GPT-5 eine KI, die „einfach funktioniert“ – ohne komplizierte Modellwahl, mit verbesserter Agentenfähigkeit und kostenlos für alle. Das klingt nach einem logischen nächsten Schritt in der KI-Entwicklung. Doch hinter der Vereinfachung steckt eine weitreichende strategische Neuausrichtung, die nicht nur Vorteile bringt. Wer sich jetzt auf GPT-5 einlässt, sollte genau prüfen, welche Risiken damit verbunden sind.

Ein zentraler Punkt ist die Verschmelzung verschiedener Fähigkeiten in einem einzigen Modell. OpenAI möchte den Spagat zwischen Geschwindigkeit und Tiefe auflösen und eine universelle Lösung bieten. Doch die Frage bleibt: Kann ein einzelnes Modell wirklich gleichzeitig schnell, präzise und flexibel genug sein? Oder droht eine Mittelmäßigkeit, die spezialisierte Lösungen am Ende doch wieder notwendig macht? Falls GPT-5 nicht in der Lage ist, einfache Anfragen effizient zu bearbeiten, ohne an Tiefe bei komplexen Aufgaben zu verlieren, könnte die vermeintliche Vereinfachung in der Praxis mehr Probleme schaffen als lösen.

Auch die Kosten- und Kontrollstruktur wirft Fragen auf. OpenAI macht GPT-5 in einer Basisversion kostenlos zugänglich, während leistungsfähigere Varianten zahlenden Nutzern vorbehalten bleiben. Das schafft zunächst eine niedrige Einstiegshürde, birgt aber das Risiko langfristiger Abhängigkeiten. Falls OpenAI später Preismodelle ändert oder kritische Funktionen exklusiv für Premium-Kunden reserviert, könnte die Entscheidung für GPT-5 mit unerwarteten Kosten verbunden sein. Wer früh auf OpenAIs Lösung setzt, sollte sich bewusst sein, dass strategische Flexibilität und alternative KI-Anbieter in Zukunft essenziell sein könnten.

Ein weiterer zentraler Punkt sind die „agentischen“ Fähigkeiten von GPT-5. OpenAI will seine KI autonomer machen, sodass sie komplexe Aufgaben eigenständig ausführt. Das könnte Automatisierungsprozesse auf ein neues Niveau heben – aber auch neue Kontrollprobleme schaffen. Denn mit zunehmender Eigenständigkeit wird es schwieriger, Entscheidungen der KI nachzuvollziehen oder ungewollte Effekte zu verhindern. Ohne klar definierte Mechanismen zur Kontrolle und Steuerung könnte die Nutzung solcher Systeme schnell zu regulatorischen oder operativen Herausforderungen führen.

GPT-5 wird unbestreitbar neue Möglichkeiten schaffen, doch OpenAIs Strategie verlangt eine kritische Bewertung. Wer sich jetzt für dieses Modell entscheidet, sollte nicht nur die kurzfristigen Vorteile sehen, sondern auch die langfristigen Auswirkungen auf Kosten, Kontrolle und operative Prozesse abwägen. Eine vorschnelle Abhängigkeit von einer einzigen Plattform könnte später schwer zu korrigieren sein – und genau hier liegt die größte strategische Herausforderung.

Sie sind einer anderen Meinung? Oder Sie wollen einen Gastbeitrag veröffentlichen? Schreiben Sie uns gerne eine E-Mail, indem Sie einfach auf diese Mail antworten.

Praxisbeispiel

Adobe Firefly Video Model macht hochwertige KI-Videos kommerziell sicher

Problemstellung: Die Erstellung hochwertiger Videoinhalte ist oft zeitaufwendig und erfordert spezialisierte Kenntnisse in Animation, Schnitt und Effekten. Zudem bestehen bei generativer KI häufig Bedenken hinsichtlich Urheberrechten und kommerzieller Nutzungssicherheit.

Lösung: Adobe Firefly Video Model bietet eine IP-sichere, kommerziell nutzbare KI zur Videogenerierung, die nahtlos mit anderen Adobe-Tools wie Photoshop und Premiere Pro integriert ist. Nutzer können per Texteingabe Videos in bestimmten Stilen und Kameraperspektiven erstellen, Bilder in bewegte Clips umwandeln und bestehendes Material mit neuen Elementen erweitern.

Anwendungsbeispiele: Firefly generiert Landschaftsaufnahmen, atmosphärische Effekte wie Nebel oder Flammen sowie realistische Tierbewegungen. Zudem ermöglicht es die Erstellung von 2D- und 3D-Animationen, Storyboards und visuelle Konzeptpräsentationen. Das Modell unterstützt 1080p-Videoausgabe und bietet erweiterte Steuerungsmöglichkeiten, darunter Keyframes und gezielte Kameraeinstellungen.

Erklärungsansatz: Die KI nutzt ausschließlich lizenzierte Inhalte für das Training und gewährleistet somit kommerzielle Sicherheit. Funktionen wie automatische Übersetzung und Lippensynchronisation erleichtern die Lokalisierung von Videos. Durch nahtlose Integration in Creative Cloud-Anwendungen optimiert Firefly den gesamten kreativen Workflow – von der Ideenfindung bis zur finalen Produktion.

Fazit: Das neue Adobe Firefly Video Model verbessert die Videoproduktion erheblich, indem es kreative Kontrolle mit KI-gestützter Effizienz kombiniert. Es bietet eine sichere, innovative Lösung für Filmemacher, Designer und Content Creator, um schneller hochwertige visuelle Inhalte zu erstellen.

YouTube

Das Geheimnis der Proteine und die Zukunft der Wissenschaft

Was wäre, wenn die größten Probleme der Menschheit – von Krankheiten über Umweltverschmutzung bis hin zum Klimawandel – eine gemeinsame Lösung hätten? Eine Lösung, so klein, dass sie mit bloßem Auge unsichtbar ist? Dank eines bahnbrechenden Durchbruchs in der Biologie rückt dieser Gedanke in greifbare Nähe: Die Entschlüsselung der Proteinstrukturen mithilfe von Künstlicher Intelligenz.

Proteine sind die Bausteine des Lebens. Ihre Form bestimmt ihre Funktion – von der Sauerstoffversorgung im Blut bis hin zur Bekämpfung von Krankheiten. Doch das Bestimmen ihrer komplexen 3D-Strukturen war jahrzehntelang eine gigantische Herausforderung. Während Wissenschaftler in über 60 Jahren nur 150.000 Strukturen entschlüsselten, revolutionierte das KI-Programm AlphaFold von DeepMind das Feld in wenigen Jahren: Es sagte die Struktur von über 200 Millionen Proteinen mit beeindruckender Präzision voraus.

Diese Entwicklung ist weit mehr als ein wissenschaftlicher Erfolg – sie hat das Potenzial, die Welt zu verändern. AlphaFold hilft bereits bei der Entwicklung neuer Medikamente, beim Verständnis genetischer Krankheiten und sogar bei der Zersetzung von Plastik. Doch das ist erst der Anfang. Mit der Kombination aus KI und synthetischen Proteinen könnten wir in Zukunft Krebs heilen, Treibhausgase effizienter binden oder neue Materialien mit bahnbrechenden Eigenschaften erschaffen.

Die Geschwindigkeit, mit der KI die Wissenschaft transformiert, ist atemberaubend. Während traditionelle Forschungsmethoden Jahrzehnte brauchten, erzielt KI Lösungen in Wochen oder gar Tagen. Das bedeutet nicht nur eine neue Ära der Biologie, sondern eine Revolution in der gesamten Wissenschaft. Doch wie weit können wir gehen? Und welche ethischen Fragen stellen sich? Die Zukunft liegt in der Balance zwischen Fortschritt und Verantwortung – und wir stehen erst am Anfang.

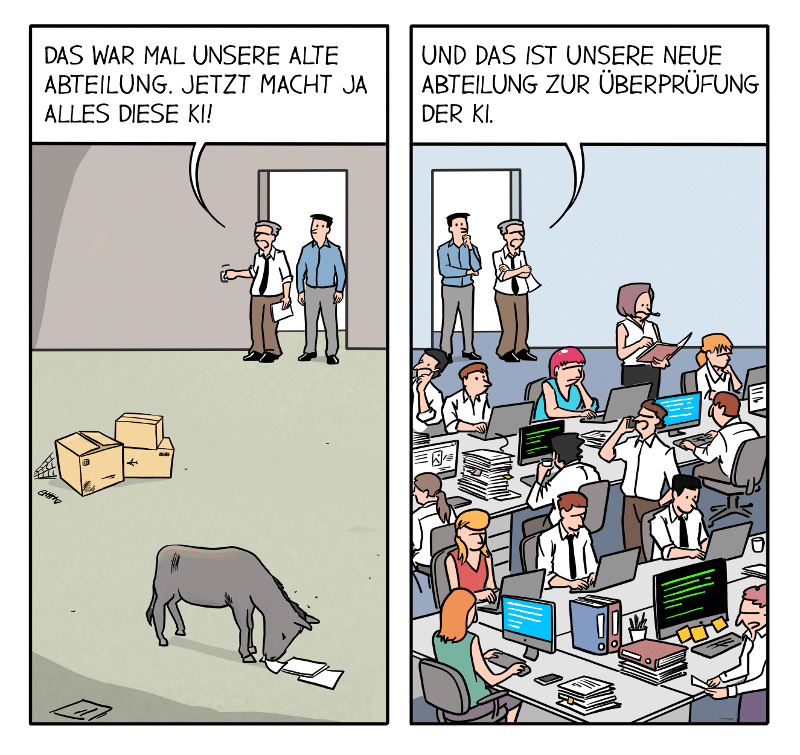

Cartoon

Wandel der Arbeit 😅

Und nächste Woche…

... werfen wir einen Blick auf die neue Management-Superkraft: KI als Co-Denker. Wie können Führungskräfte Generative AI nutzen, um strategischer zu denken, bessere Entscheidungen zu treffen und kreativer Probleme zu lösen? Welche Methoden und Ansätze haben sich in der Praxis bewährt? Und wo liegen die Grenzen dieser Technologie? Freuen Sie sich auf eine fundierte Analyse der neuen Rolle von KI im Management – und darauf, wie Sie diese Entwicklung für sich nutzen können.

Wir freuen uns, dass Sie das KI-Briefing regelmäßig lesen. Falls Sie Vorschläge haben, wie wir es noch wertvoller für Sie machen können, spezifische Themenwünsche haben, zögern Sie nicht, auf diese E-Mail zu antworten. Bis zum nächsten mal mit vielen neuen spannenden Insights.

Wie hat Ihnen das heutige KI-Briefing gefallen?

Fragen, Feedback & Anregungen

Schreiben Sie uns auf WhatsApp! Wir nehmen dort Feedback und Fragen entgegen - klicken Sie auf das Icon und Sie sind direkt mit uns im Gespräch.